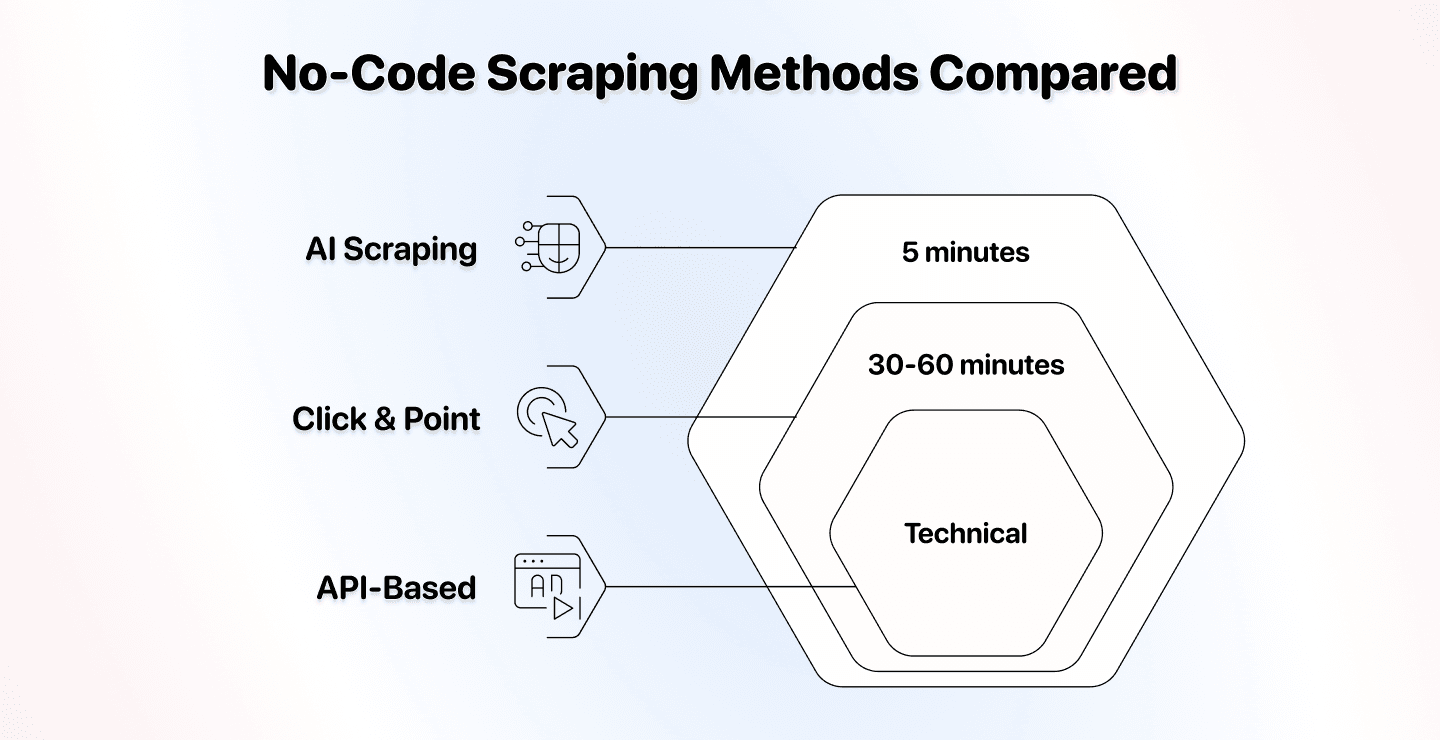

Il mondo del no-code scraping offre tre approcci distinti e sceglierne quello sbagliato ti farà perdere tempo e budget.

Abbiamo confrontato AI scraping, scraping no-code tradizionale e scraping via API per mostrarti le vere differenze. Zero fuffa, solo fatti su tempo di setup, flessibilità, prezzo e casi d’uso ideali.

Alla fine di questa guida saprai esattamente quale metodo fa per te.

📌 Riepilogo per chi ha fretta

Questo articolo confronta tre metodi di no-code scraping per aiutarti a scegliere quello giusto per le tue esigenze.

La domanda: Quale metodo di no-code scraping dovresti usare nei tuoi progetti?

Cosa abbiamo confrontato: AI scraping, strumenti click-and-point e scraper via API in base a difficoltà di setup, flessibilità, prezzo, casi d’uso e tool consigliati.

La risposta breve:

- AI scraping è il più semplice per chi non è tecnico e si adatta ai cambi di layout

- Gli strumenti click-and-point vanno meglio quando serve controllo preciso e i siti cambiano raramente

- Lo scraping via API è il più economico ma richiede competenze tecniche

Cosa imparerai: Come funziona ogni metodo, cosa li differenzia, quando usarli e quali tool danno i risultati migliori.

Cosa trovi in questo articolo

- AI Scraping: il metodo che capisce il linguaggio naturale

- Scraping No-Code Tradizionale: Click-and-Point Tools

- Scraping via API: la via di mezzo tecnica

- La nostra sintesi su quale metodo scegliere

AI Scraping

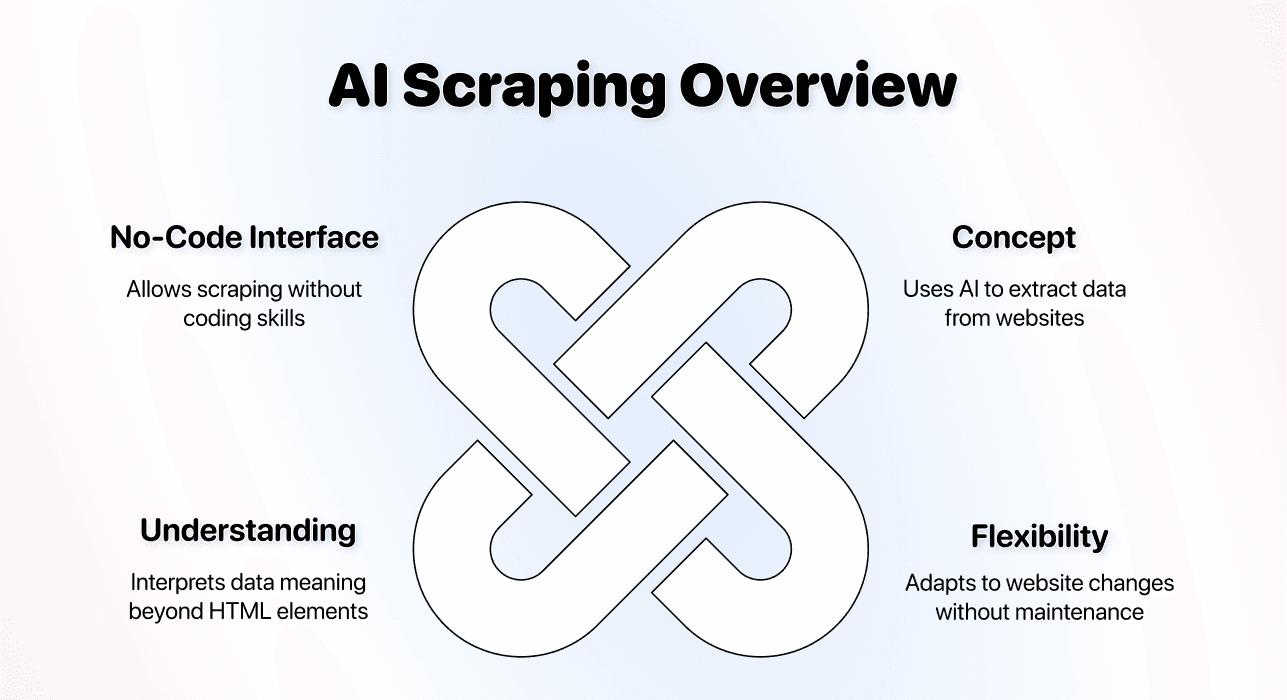

L’AI scraping è la forma più recente di estrazione dati no-code. Usa l’intelligenza artificiale per capire cosa vuoi e si occupa di come ottenerlo.

Il concetto

I tool di AI scraping usano large language models e machine learning per estrarre dati dai siti. Tu descrivi cosa ti serve in linguaggio naturale e l’AI gestisce i dettagli tecnici.

Le persone lo chiamano in modi diversi (AI no-code scraping, AI data scraping, AI web scraping), ma il concetto è lo stesso: usare tool AI per fare scraping senza scrivere codice o configurare selettori tecnici.

Cosa lo rende diverso:

↳ Gli scraper tradizionali seguono regole rigide che imposti tu

↳↳ Gli AI scraper capiscono il contesto e si adattano ai cambiamenti

↳↳↳ Risultato: meno manutenzione e molta più flessibilità

L’AI non cerca solo elementi HTML specifici. Capisce che “prezzo prodotto” significa trovare il costo dell’articolo, a prescindere da come il sito struttura quell’informazione.

Difficoltà di setup

L’AI scraping ha il setup più semplice tra i tre metodi.

Workflow tipico:

- Scegli il tuo tool di AI scraping

- Inserisci l’URL del sito

- Descrivi i dati che vuoi in linguaggio naturale

- Avvia lo scraper

Tempo richiesto: 5 minuti per la maggior parte dei siti[1]. Non devi conoscere HTML, selettori CSS o l’architettura del sito. L’AI capisce dove trovare i dati partendo dalla tua descrizione.

Ecco un video in cui uso un AI scraping agent per estrarre dati da un e-commerce in 6,04 minuti 📺

La skill principale: Comunicazione chiara. Se sai descrivere cosa vuoi, puoi avviare l’AI scraping in pochi minuti.

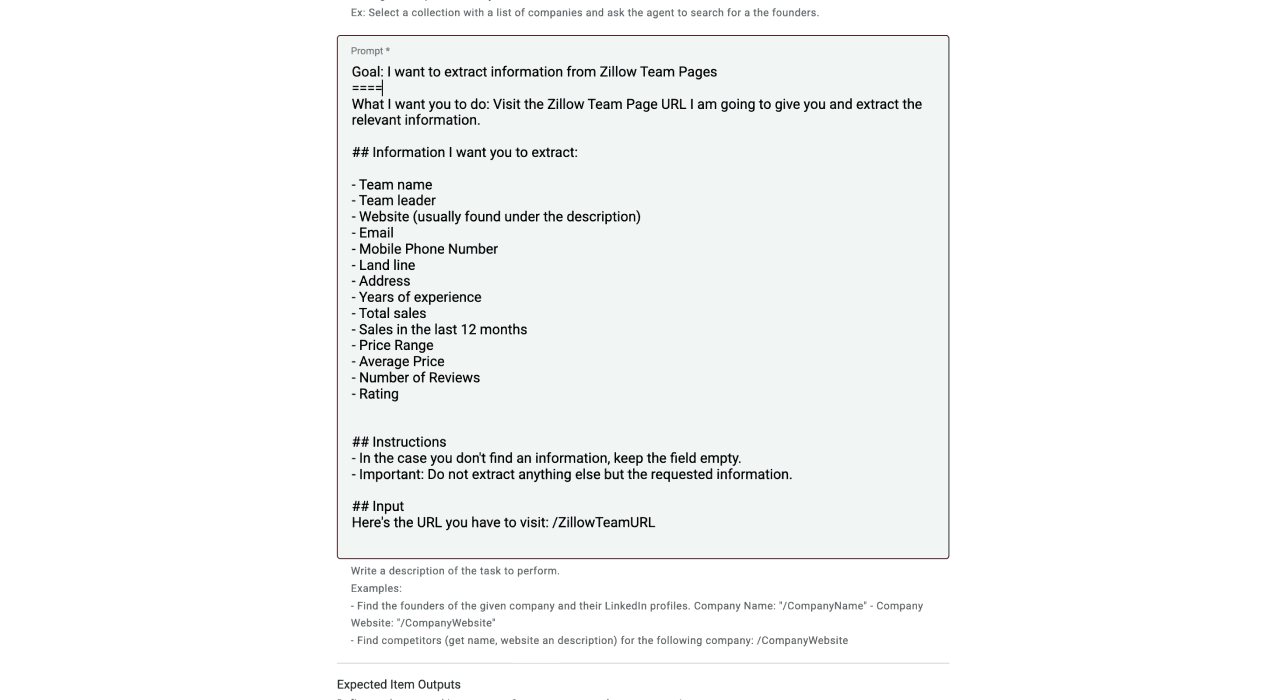

Alcuni template di AI scraping utili

Creiamo spesso template di scraping per i nostri utenti ❤️. Eccone alcuni che potrebbero servirti:

- How to scrape the YC Startup directory

- How to scrape properties from Zillow

- How to scrape real estate agents from Zillow

- How to scrape properties from AirBnB

- How to scrape businesses from Yellow Pages

- How to scrape an e-commerce shop

- How to scrape case studies from a website

Questi template sono disponibili anche nella Datablist app e si avviano in pochi, letterali click. Se vuoi che creiamo un template per te, scrivici qui 👈🏽

Flessibilità

Qui l’AI scraping brilla davvero rispetto agli altri metodi.

L’AI scraping si adatta automaticamente quando:

↳ I siti ridisegnano il layout

↳↳ I contenuti compaiono in posizioni inaspettate

↳↳↳ Pagine diverse usano strutture HTML differenti

Gli scraper no-code o con codice si rompono ai cambiamenti perché cercano elementi HTML specifici. Gli AI scraper capiscono il significato, quindi continuano a funzionare anche quando cambia la struttura tecnica: una volta impostato, un AI scraper resta stabile.

Esempio: Devi estrarre info prodotto da vari e-commerce, ognuno con HTML diverso. Con l’AI scraping usi lo stesso prompt per tutti e l’agente si adatta alla struttura di ciascun sito.

Il limite: L’AI scraping dà il meglio con dati pubblici. Non gestisce bene flussi di autenticazione complessi o contenuti dietro login come farebbe uno scraper custom.

Prezzo

Di solito l’AI scraping costa di più per operazione perché usa risorse computazionali per capire e processare le pagine.

Modelli di prezzo tipici:

- Piani in abbonamento con crediti inclusi

Fattori che incidono sui costi:

- Siti con molto JavaScript costano di più (serve il rendering)

- Paginazione e task multi-step aumentano i costi

- Directory semplici costano meno

Esempio reale: Estrarre 1.000 schede aziendali da una directory può costare 500–1.000 crediti nella maggior parte dei tool di AI scraping. Il costo preciso dipende dalla complessità della pagina e dalla quantità di dati estratti.

Ne vale la pena? Per chi non è tecnico, sì. Paghi per il tempo risparmiato, zero manutenzione e soprattutto per la tranquillità. Potremmo definirlo “scraping senza mal di testa”.

Casi d’uso e best practice

L’AI scraping funziona al meglio in scenari in cui i suoi punti di forza fanno la differenza.

Casi d’uso ideali:

- Scraping di più siti con strutture diverse

- Estrazione dati se non sei tecnico

- Progetti in cui la manutenzione costa

- Siti che cambiano spesso

- Raccolta di dati eterogenei che richiedono comprensione del contesto

- Non vuoi configurare uno scraper no-code tradizionale o un’API

Quando scegliere l’AI scraping: Devi raccogliere dati dai siti dei competitor per market research, ma ognuno usa builder e layout diversi. L’AI scraping gestisce tutto con lo stesso prompt.

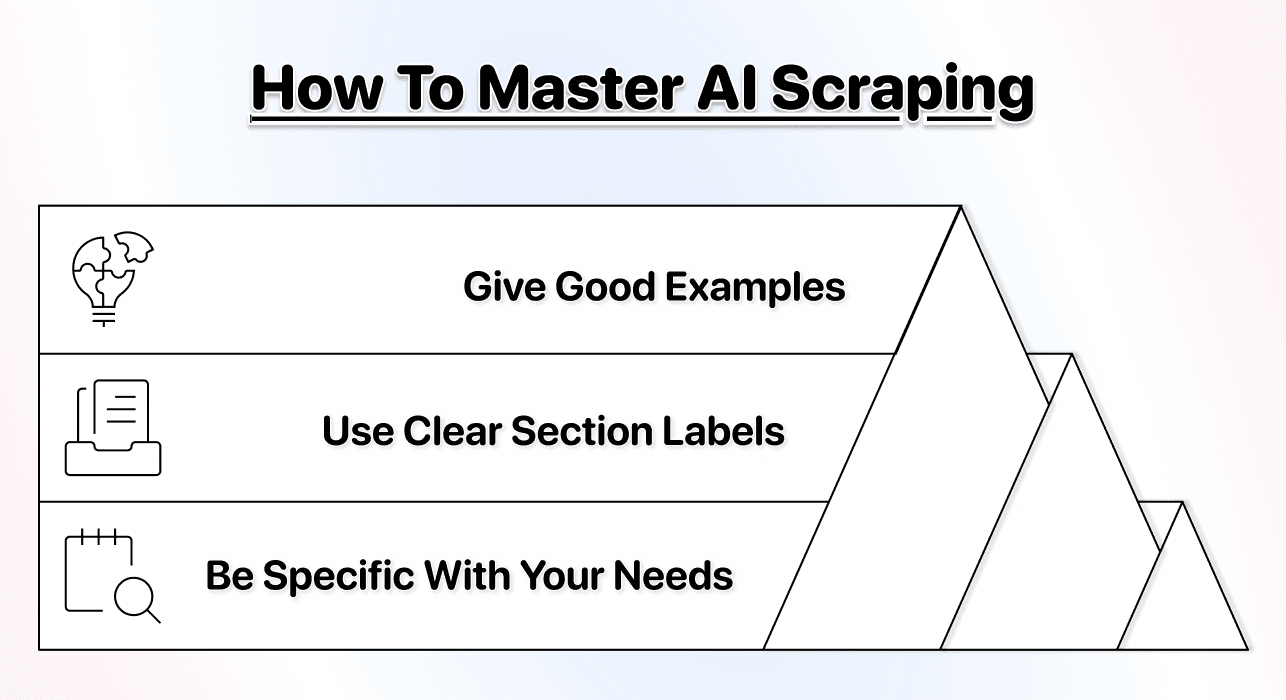

Best practice per l’AI scraping:

- Scrivi prompt chiari e specifici su quali dati ti servono

- Fornisci esempi quando possibile per migliorare l’accuratezza[2]

- Parti con piccoli test prima di scalare

- Usa sezioni e label nei prompt per risultati migliori

Qui trovi una guida utile se vuoi approfondire come scrivere prompt per un AI agent 👈🏽

Miglior tool da usare

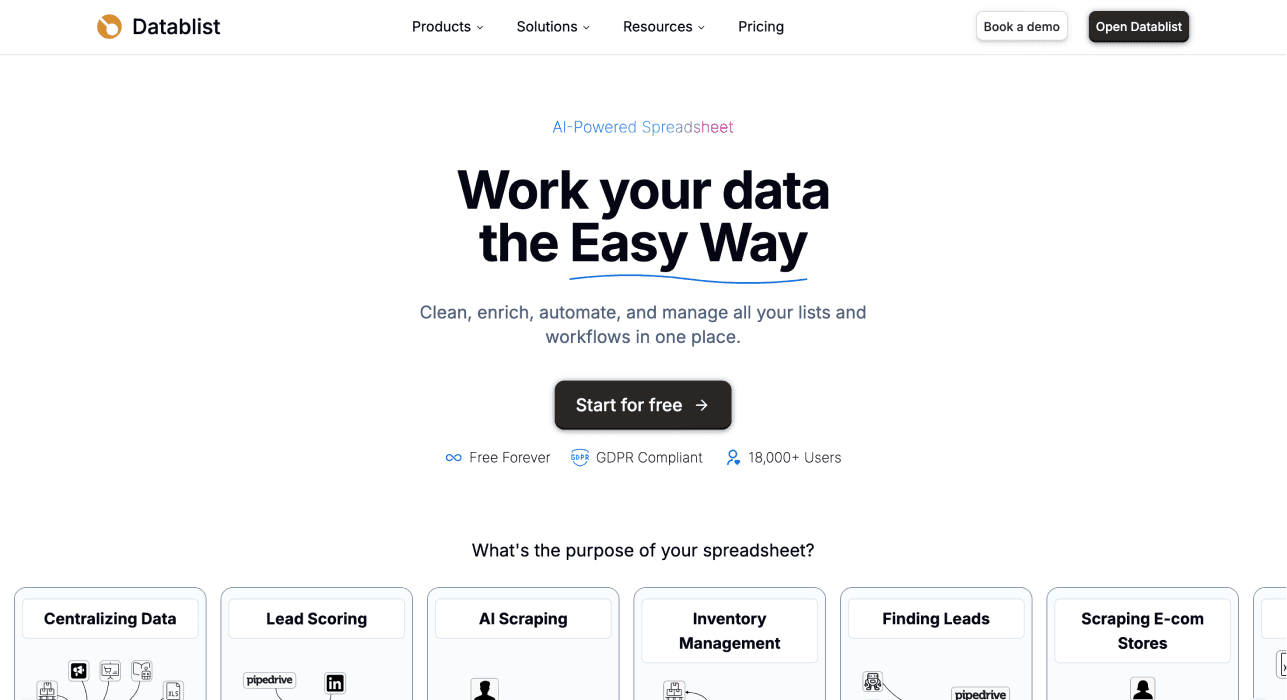

Per l’AI scraping, Datablist spicca come la scelta migliore per chi non è tecnico[3]

Perché Datablist funziona:

- True natural language prompting[4] (nessuna competenza tecnica richiesta)

- Più AI agent specializzati per task di scraping differenti[5]

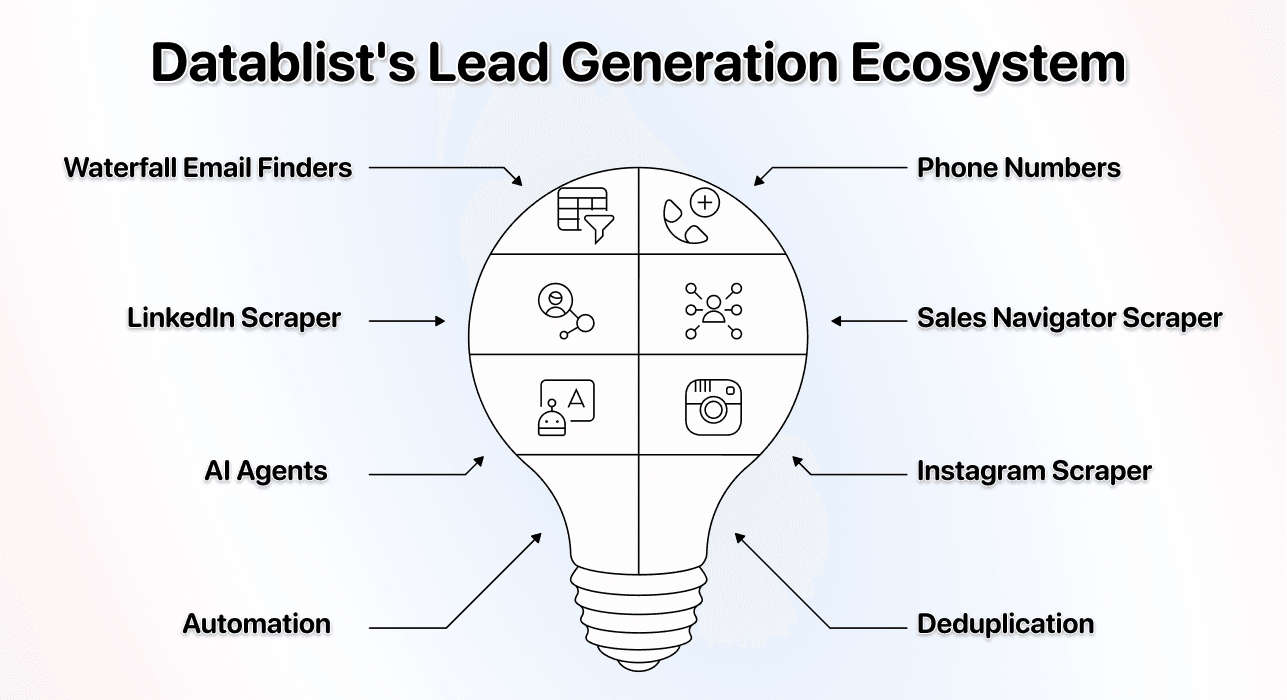

- Ecosistema integrato con 60+ lead generation tools

- Gestisce automaticamente rendering JavaScript e paginazione[6]

- Pricing accessibile a partire da $25/mese

- Ha funzionalità di bulk enrichment integrate

Cosa la rende diversa: Datablist non è solo un AI scraper. È una piattaforma completa di lead generation che include AI scraping insieme a email finder, sales navigator scraper e strumenti di cleaning. Puoi fare scraping di una lista e arricchirla subito con i contatti senza cambiare tool.

Il vantaggio principale di Datablist: Ottieni AI scraping più una piattaforma di automazione completa pensata per data enrichment, lead list building o qualsiasi workflow di lead generation, a un costo inferiore rispetto a molti scraper stand‑alone.

📘 AI Scraping è tecnicamente anche No-Code

L’AI scraping è una sottocategoria del no-code scraping perché non richiede codice. È il metodo no-code più semplice: servono solo istruzioni in linguaggio naturale, non la comprensione della struttura dei siti.

Scraping No-Code Tradizionale (Click-and-Point Tools)

Gli scraper click-and-point sono stati la prima soluzione “no-code”. Ti permettono di selezionare visivamente i dati su una pagina invece di scrivere codice. In questa sezione li chiamiamo anche “scraper no-code tradizionali”.

Il concetto di scraper no-code tradizionali

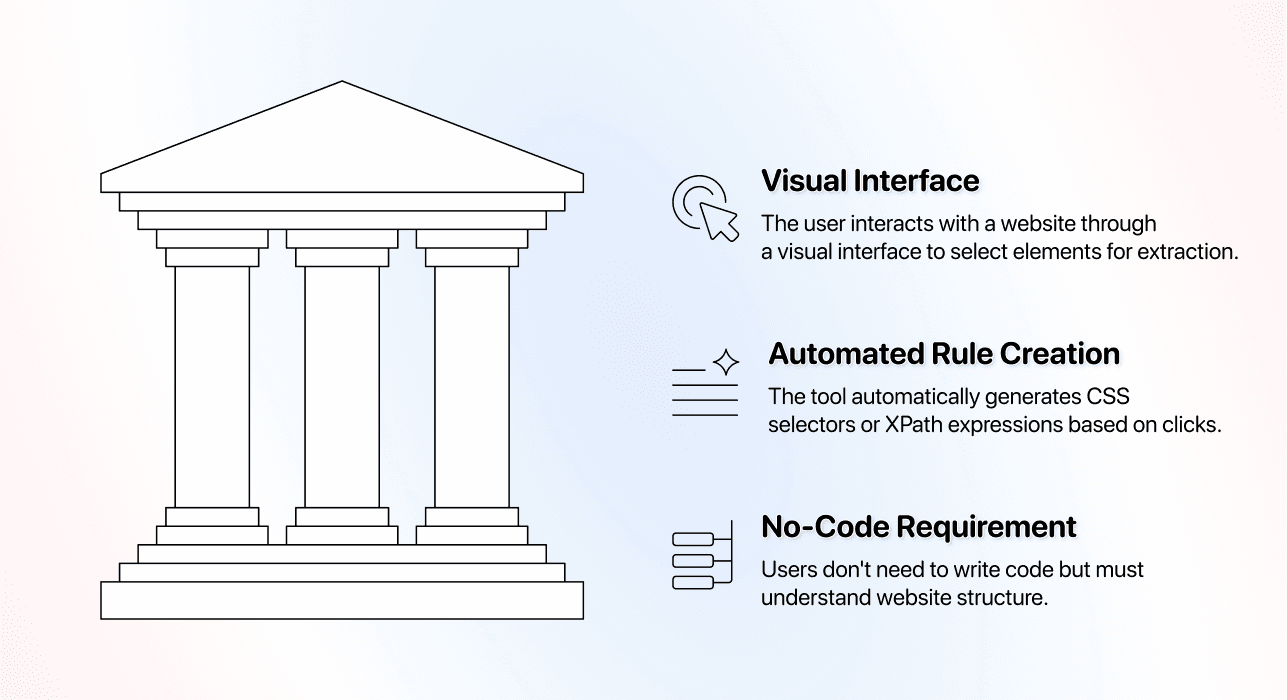

Lo scraping no-code tradizionale usa interfacce visuali in cui clicchi sugli elementi della pagina per dire allo strumento cosa estrarre.

Workflow di base: Apri il sito nel tool, clicchi sul nome del prodotto, poi sul prezzo, poi sulla descrizione. Il tool registra i click e crea uno scraper basato su quelle selezioni.

Cosa succede dietro le quinte: Il tool converte i tuoi click in selettori CSS o espressioni XPath. Non stai scrivendo codice, ma stai comunque creando regole tecniche rigide che dipendono dal fatto che l’HTML del sito resti invariato.

Perché è “no-code”: Non scrivi Python o JavaScript. Ma devi capire come i siti organizzano le informazioni e, a volte, fare troubleshooting quando certi elementi non vengono selezionati correttamente.

Difficoltà di setup

Gli strumenti click-and-point hanno una curva di apprendimento media che spesso sorprende chi inizia.

Il processo di setup:

- Scarica e installa il tool (molti sono app desktop)

- Apri il sito target nel tool

- Clicca su ogni dato che vuoi estrarre

- Configura la paginazione se serve

- Fai dei test per verificare l’estrazione

- Effettua il debug quando vengono selezionati elementi sbagliati

- Salva ed esegui lo scraper

Tempo richiesto: 30–60 minuti per un sito di complessità media.

❗️ Attenzione a questo

C’è una complessità nascosta nei tool click-and-point: gli elementi non vengono sempre selezionati correttamente. A volte clicchi un numero di telefono e il tool seleziona l’intera sezione contatti, e non puoi risolverlo perché la causa è nel sito, non nello scraper. Se capita, dovrai pulire i dati dopo lo scraping.

Frustrazioni comuni per chi inizia con gli scraper no-code tradizionali:

- Clicchi un elemento e se ne seleziona un altro

- Chattare con i team di supporto diventa routine

- La paginazione non funziona come previsto

- I dati risultano mescolati invece che in campi separati

- Gli scraper si rompono dopo gli aggiornamenti del sito

Per chi è facile: Chi ha confidenza con la tecnologia e guarda qualche tutorial può padroneggiarli. Aspettati qualche ora di apprendimento prima di essere produttivo.

Flessibilità

Gli strumenti click-and-point sono rigidi per definizione. Estraggono esattamente ciò che configuri, come lo configuri.

Cosa succede quando i siti cambiano:

↳ Un redesign del layout può rompere lo scraper

↳↳ Anche piccoli update CSS possono bloccare l’estrazione

↳ ↳↳Devi ricostruire lo scraper da zero

Il peso della manutenzione: I siti si aggiornano di continuo. I grandi e-commerce potrebbero aggiornarsi ogni trimestre. Ogni update significa riconfigurare lo scraper, con lo stesso effort del setup iniziale.

Gestire più siti: Se fai scraping di cinque siti competitor, ti servono cinque configurazioni diverse. Ognuna si rompe in modo indipendente quando quel sito cambia.

Il vantaggio dei click-and-point: Quando i siti cambiano raramente (es. database della PA o directory stabili), gli strumenti click-and-point offrono estrazioni affidabili e consistenti una volta configurati correttamente.

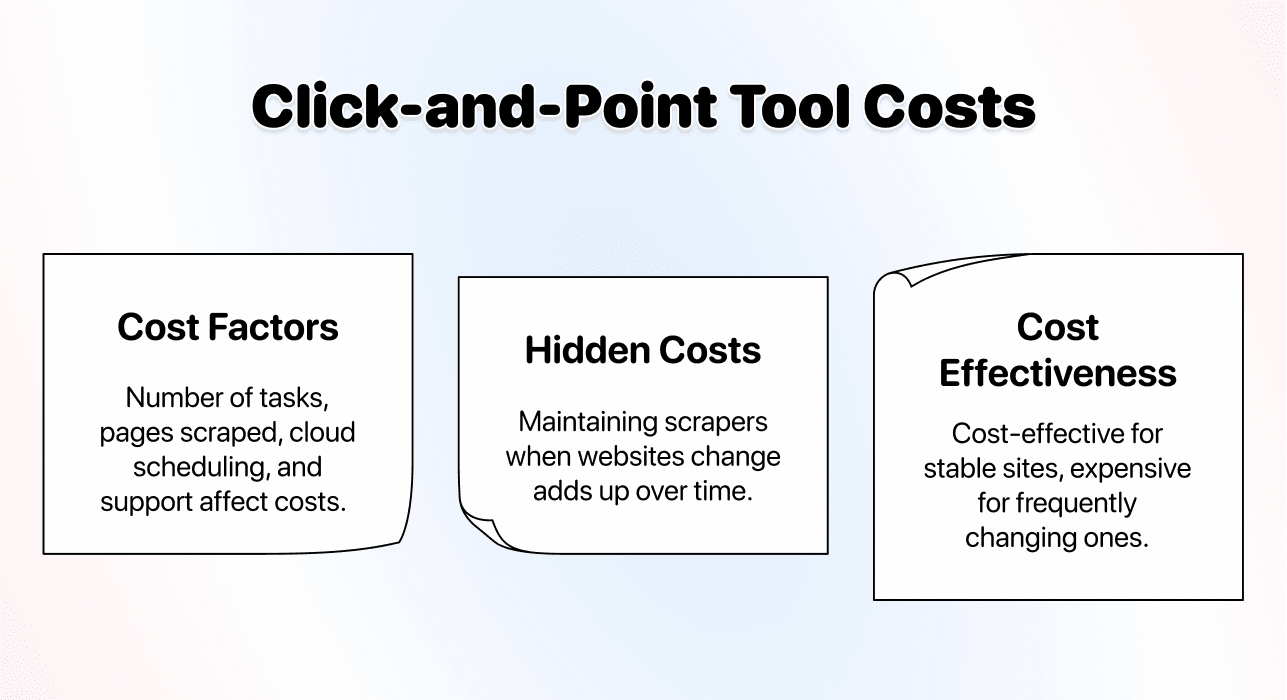

Prezzo

I tool click-and-point usano in genere pricing a abbonamento con piani a tier.

Strutture di prezzo comuni:

- Piani entry: $50–100/mese

- Piani professional: $150–300/mese

- Piani enterprise: $500+/mese

Cosa incide sui costi:

- Numero di task di scraping che puoi creare

- Quante pagine puoi estrarre al mese

- Accesso a scheduling in cloud

- Support prioritario e feature avanzate

Costi nascosti da considerare: Il tempo per mantenere gli scraper quando i siti cambiano. Se passi 5 ore al mese a sistemare scraper rotti, è un costo reale, anche se l’abbonamento sembra conveniente.

Convenienza: Per siti che cambiano di rado, i tool click-and-point possono essere economici dopo il setup. Per siti che cambiano spesso, la manutenzione li rende costosi. In quel caso potresti valutare un AI scraping agent

Casi d’uso e best practice

Gli strumenti click-and-point eccellono quando i loro limiti non pesano.

Casi d’uso ideali:

- Scraping di siti stabili che si aggiornano raramente

- Progetti in cui serve controllo molto preciso sull’estrazione

- Situazioni in cui estrai dallo stesso sito in modo ripetuto

- Workflow desktop in cui gli strumenti cloud non sono necessari

Quando i click-and-point sono la scelta giusta: Devi estrarre dati da un database pubblico che si aggiorna spesso ma non cambia mai struttura. Una volta configurato bene, lo strumento estrarrà i nuovi dati ogni giorno, a patto che riesca a selezionare correttamente gli elementi giusti.

Best practice:

- Documenta le configurazioni degli scraper per quando si romperanno

- Imposta monitoraggi per rilevare quando smettono di funzionare

- Metti a budget tempo per la manutenzione mensile

- Testa bene prima di scalare su grandi volumi

Quando evitare i click-and-point: Se devi fare scraping di molti siti moderni che si aggiornano spesso (per esempio e-commerce), la manutenzione diventa pesante. Ogni update richiede intervento manuale.

Miglior tool da usare

Octoparse è il tool click-and-point più affermato sul mercato.

A proposito, qui trovi un articolo in cui ho confrontato i migliori no-code scrapers per facilità d’uso, integrazioni e prezzo 👈🏽

Perché Octoparse:

- Interfaccia matura con anni di sviluppo

- Ampia libreria di tutorial per gli scenari più comuni

- Applicazione desktop con funzionalità potenti

- Buona documentazione e community

I trade-off: Octoparse richiede tempo per essere imparato. L’interfaccia è potente ma complessa. Il pricing parte da $83/mese, non proprio economico per individui e piccoli team.

Per chi è indicato: Team a proprio agio con la tecnologia che devono estrarre da siti stabili e possono giustificare curva di apprendimento e costo dell’abbonamento.

💡 Gli scraper tradizionali hanno ancora il loro perché

Gli strumenti click-and-point non sono “cattivi”; semplicemente vivono all’ombra di metodi più semplici come l’AI scraping. Per siti “vecchi” e immutabili, come certe directory della PA, funzionano ancora bene.

Scraping via API

Lo scraping basato su API è la via di mezzo tra code e no-code. Tecnicamente è no-code (non scrivi la logica di scraping), ma serve competenza tecnica per usarlo.

Il concetto

Gli scraper via API offrono endpoint preconfigurati per siti o casi d’uso specifici.

Come funziona: Fai una chiamata API con dei parametri (l’URL da analizzare e i campi desiderati) e il servizio restituisce dati strutturati. La logica di scraping è già pronta; tu la configuri tramite parametri.

Tecnicamente è no-code, ma devi saper fare chiamate API, gestire token di autenticazione, interpretare risposte JSON e integrare i risultati nel tuo workflow. Servono conoscenze di programmazione o familiarità con tool come Postman.

Approcci API comuni:

-

API specifiche per singoli siti (es. LinkedIn scraper APIs)

-

API generiche per fare scraping di qualsiasi URL

-

API basate su template per siti popolari

Ambiguità nel naming: Alcuni lo chiamano “no-code” perché non scrivi la logica. Altri “low-code” perché richiede skill tecniche. La verità sta nel mezzo.

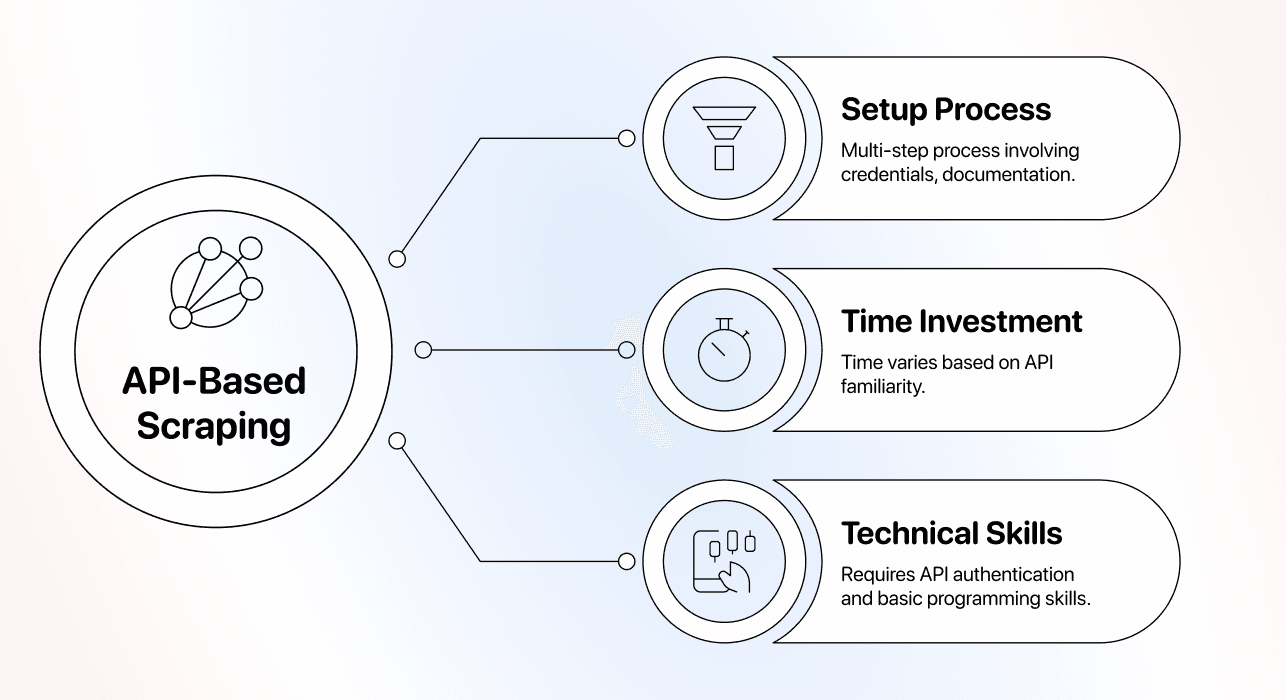

Difficoltà di setup

Lo scraping via API richiede competenze che lo allontanano dal vero “no-code”.

Il processo di setup:

- Registrati e ottieni le credenziali API

- Leggi la documentazione per capire i parametri

- Testa le chiamate con Postman o curl

- Gestisci autenticazione e rate limiting

- Effettua il parsing della risposta JSON o XML

- Integra i risultati nella tua app o workflow

- Implementa gestione degli errori per le richieste fallite

Tempo richiesto: 1–2 ore se sei a tuo agio con le API, molto di più se stai imparando.

Competenze tecniche richieste:

- Comprendere REST API e richieste HTTP

- Lavorare con strutture dati JSON

- Gestire token di autenticazione e header

- Programmazione di base per integrare i risultati nel workflow

Flessibilità

Gli scraper via API offrono flessibilità media, che dipende totalmente dal provider.

Cosa puoi controllare: La maggior parte consente di specificare i campi da estrarre, impostare rate limit, scegliere formati di output e configurare alcuni comportamenti via parametri.

Cosa non puoi controllare: La logica sottostante è una black box. Se l’API non supporta un sito o un tipo di dato, sei bloccato. Non puoi modificarne il funzionamento.

Quando i siti cambiano: I buoni provider mantengono gli scraper e si adattano ai cambiamenti. I cattivi potrebbero non aggiornare per settimane, lasciandoti con uno scraper rotto.

Rischio di dipendenza: Dipendi totalmente dal provider. Se chiude, cambia prezzi o smette di mantenere certi scraper, il tuo workflow si ferma e non hai alternative.

Quando la flessibilità è cruciale: Se devi estrarre da siti non supportati o in modi che l’API non consente, sei senza opzioni. In questi casi, uno scraper custom o l’AI scraping potrebbero essere scelte migliori.

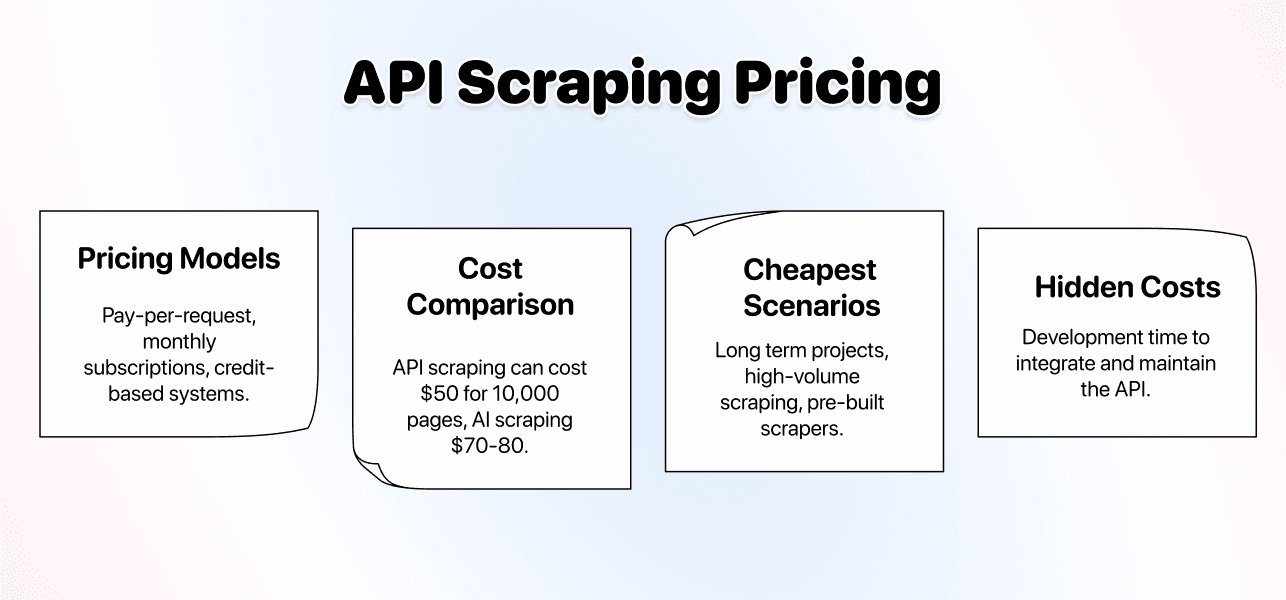

Prezzo

Lo scraping via API è spesso l’opzione più conveniente per volumi alti e task semplici.

Modelli di prezzo tipici:

- Pay‑per‑request (spesso pochi centesimi per scrape riuscito)

- Abbonamenti mensili con richieste incluse

- Sistemi a crediti con sconti volume

Confronto costi: Per 10.000 pagine semplici/mese, le soluzioni via API possono costare $50. Lo stesso volume con AI scraping potrebbe costare $70–80, ma il setup è molto più rapido.

Quando l’API è la più economica:

- Progetti di lungo periodo in cui il tempo di sviluppo non è un problema

- Scraping ad alto volume di siti semplici e stabili

- Uso di scraper preconfigurati per siti popolari

Quando diventa costosa: Se ti serve scraping custom non ben supportato dall’API, sprecherai tempo e budget per farla funzionare. La soluzione “economica” diventa inutile se non è adatta al caso d’uso.

Costi nascosti: Tempo di sviluppo per integrare e mantenere l’API. Se non sei tecnico, dovrai assumere qualcuno, cambiando totalmente l’equazione dei costi.

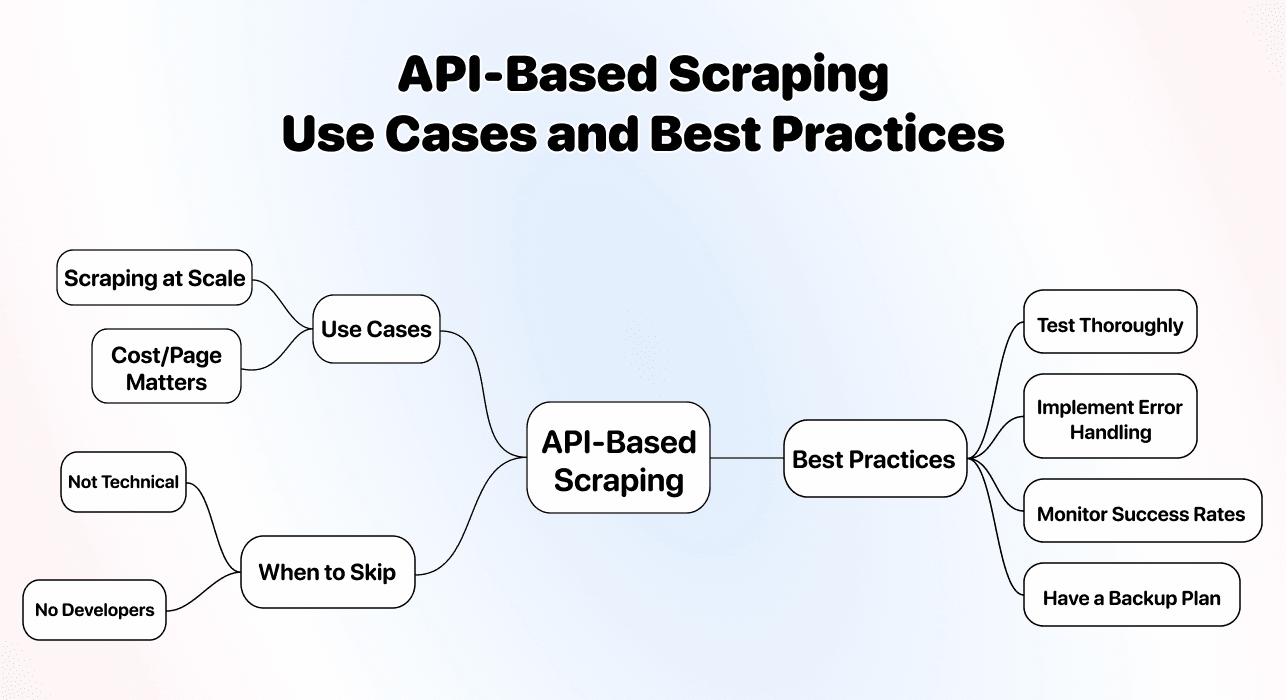

Casi d’uso e best practice

Lo scraping via API rende al meglio con team tecnici che lavorano su volumi alti e attività ripetitive.

Casi d’uso ideali:

- Scraping su larga scala (migliaia o milioni di pagine)

- Integrazione dello scraping in applicazioni

- Progetti in cui conta il costo per pagina più della facilità d’uso

Best practice:

- Testa a fondo prima di scegliere un provider

- Implementa gestione robusta degli errori

- Monitora i tassi di successo per rilevare rotture

- Prevedi un piano B se il provider chiude o cambia termini

Quando evitare le API: Se non sei tecnico e non hai developer in team, lo scraping via API ti frusterà. Il risparmio non conta se non riesci a usare lo strumento.

Miglior tool da usare

Il “migliore” scraper via API dipende da cosa devi estrarre, ma queste sono opzioni solide:

-

Per lo scraping generico: ScrapingBee e Bright Data offrono API affidabili per la maggior parte dei siti. Gestiscono proxy, rendering del browser e misure anti‑bot automaticamente.

-

Per piattaforme specifiche: Cerca API specializzate (LinkedIn scrapers, Amazon scrapers, ecc.). Sono ottimizzate per quelle piattaforme e ne gestiscono le sfide tipiche.

Cosa valutare:

- Documentazione chiara ed esempi

- Uptime e support affidabili

- Prezzi trasparenti senza costi nascosti

- Buoni tassi di successo sui tuoi siti target

La realtà: Anche i migliori scraper via API richiedono skill tecniche. Se “fare chiamate API” ti sembra complicato, scegli l’AI scraping: avrai più controllo e serenità.

💡 Lo scraping via API è conveniente ma tecnico

Lo scraping basato su API offre il miglior costo per pagina nei progetti ad alto volume, ma servono competenze per usarlo bene. Non sceglierlo solo perché è economico se poi non riesci a implementarlo; ricorda il detto: chi più spende, meno spende.

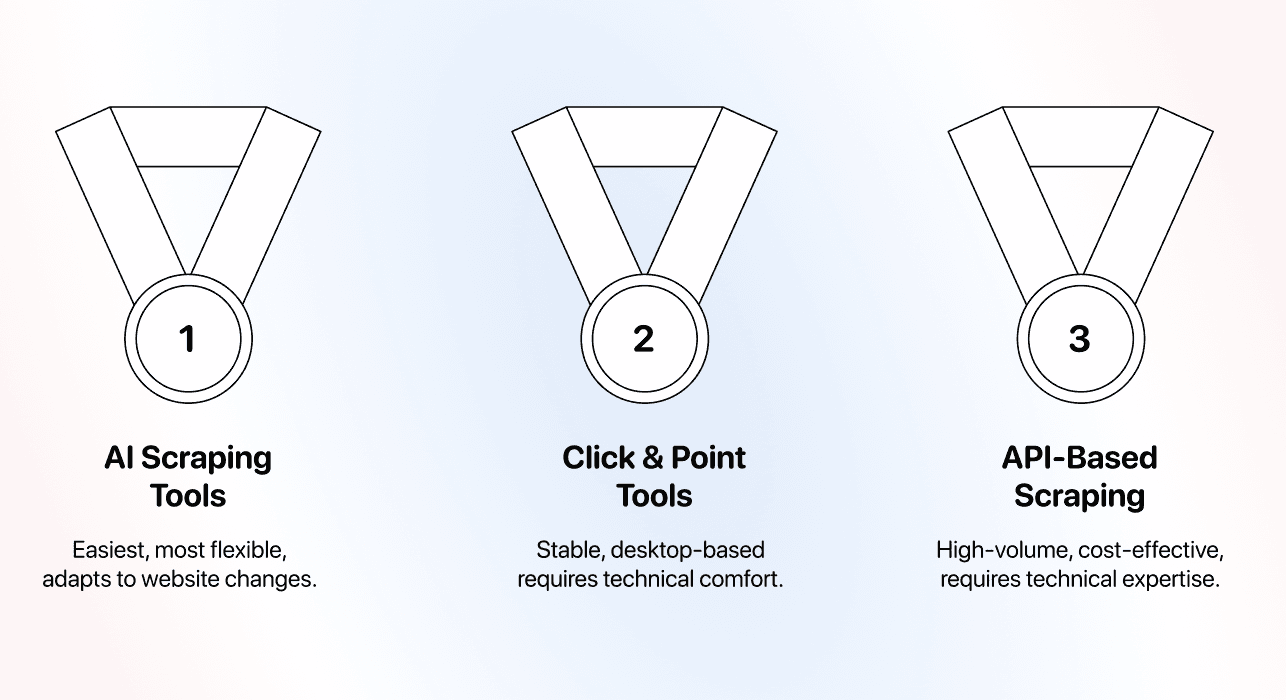

In sintesi: quale metodo dovresti scegliere?

Dopo aver confrontato i tre metodi, ecco come scegliere quello giusto per il tuo caso.

Scegli l’AI Scraping se:

- Non sei tecnico e vuoi l’opzione più semplice

- Il tempo di manutenzione per te costa

- I siti che estrai cambiano spesso

- Ti serve flessibilità per modificare facilmente i campi

Ideale per: Utenti non tecnici, piccoli team, lead list building, ricerche di mercato, competitive intelligence e progetti in cui contano tempo e semplicità più di pochi centesimi a pagina.

Miglior tool: Datablist per una vera esperienza no‑code con istruzioni in linguaggio naturale.

Scegli i tool Click-and-Point se:

- Fai scraping di siti stabili che cambiano di rado

- Sei a tuo agio con concetti tecnici

- Accetti la manutenzione quando i siti si aggiornano

- Preferisci app desktop rispetto a strumenti web

Ideale per: Team con buona confidenza tecnica, siti istituzionali o governativi stabili, progetti in cui il tempo di configurazione non è la priorità.

Miglior tool: Octoparse per feature mature e documentazione estesa.

Scegli lo scraping via API se:

- Sei tecnico o hai developer in team

- Lavori su grandi volumi (migliaia di pagine al giorno)

- Il costo per pagina è la priorità

- Devi integrare lo scraping nelle applicazioni

Ideale per: Team tecnici, progetti ad alto volume, integrazione in applicazioni, contesti in cui c’è tempo per lo sviluppo e il costo/pagina è cruciale.

Tool consigliati: ScrapingBee o Bright Data per scraping generico, API specializzate per piattaforme specifiche.

La nostra raccomandazione per la maggior parte degli utenti

Per l’80% degli utenti, l’AI scraping è la scelta giusta. Facilità d’uso, flessibilità e manutenzione minima ripagano il costo per pagina leggermente più alto.

Il panorama del no-code scraping è cambiato. Quello che prima richiedeva skill tecniche o ore di configurazione oggi si fa in minuti con istruzioni chiare.

Ecco 3 motivi semplici per cui l’AI scraping è il miglior punto di partenza:

- È il metodo più semplice

- È il metodo più flessibile

- Non richiede manutenzione

E quando vuoi scalare oltre 10.000 al giorno, puoi passare agli scraper via API.

Domande frequenti

Qual è il metodo di no-code scraping più efficiente?

L’efficienza dipende da cosa misuri. Lo scraping via API è il più economico per volumi alti se sei tecnico. L’AI scraping è il più veloce da impostare e mantenere se non sei tecnico. Per la maggior parte degli utenti, l’AI scraping offre l’efficienza migliore, eliminando barriere tecniche e manutenzione.

L’AI scraping è migliore del no-code scraping?

L’AI scraping è un tipo di no-code scraping, semplicemente la sua versione più avanzata. Di solito la domanda reale è: “L’AI scraping è meglio degli strumenti click-and-point?” La risposta è sì nella maggior parte dei casi: si adatta ai cambi dei siti, richiede meno competenze, meno manutenzione e spesso costa meno dei click-and-point.

L’AI scraping è costoso?

L’AI scraping costa di più per pagina rispetto alle API, ma meno del costo totale degli strumenti click-and-point. Per 1.000 schede in una directory, aspettati 800–1.200 crediti (il costo varia per tool e complessità). Il valore sta nello zero‑maintenance e nel fatto che non servono competenze tecniche, risparmiando tempo e denaro.

Cos’è l’AI no-code scraping?

AI no-code scraping, cioè AI scraping, significa usare l’AI per estrarre dati dai siti senza scrivere codice o configurare selettori tecnici. Descrivi in inglese semplice quali dati vuoi, l’AI capisce l’intento e gestisce i dettagli tecnici. Unisce l’accessibilità dei tool no-code con l’intelligenza di adattarsi automaticamente a strutture diverse.

Posso combinare più metodi di scraping?

Sì, e molti team lo fanno. Usa l’AI scraping per esplorazione, siti nuovi e quando serve flessibilità. Quando individui task ripetitivi e ad alto volume, valuta di spostarli su metodi via API per risparmiare, tenendo presente che richiedono competenze tecniche e più tempo.