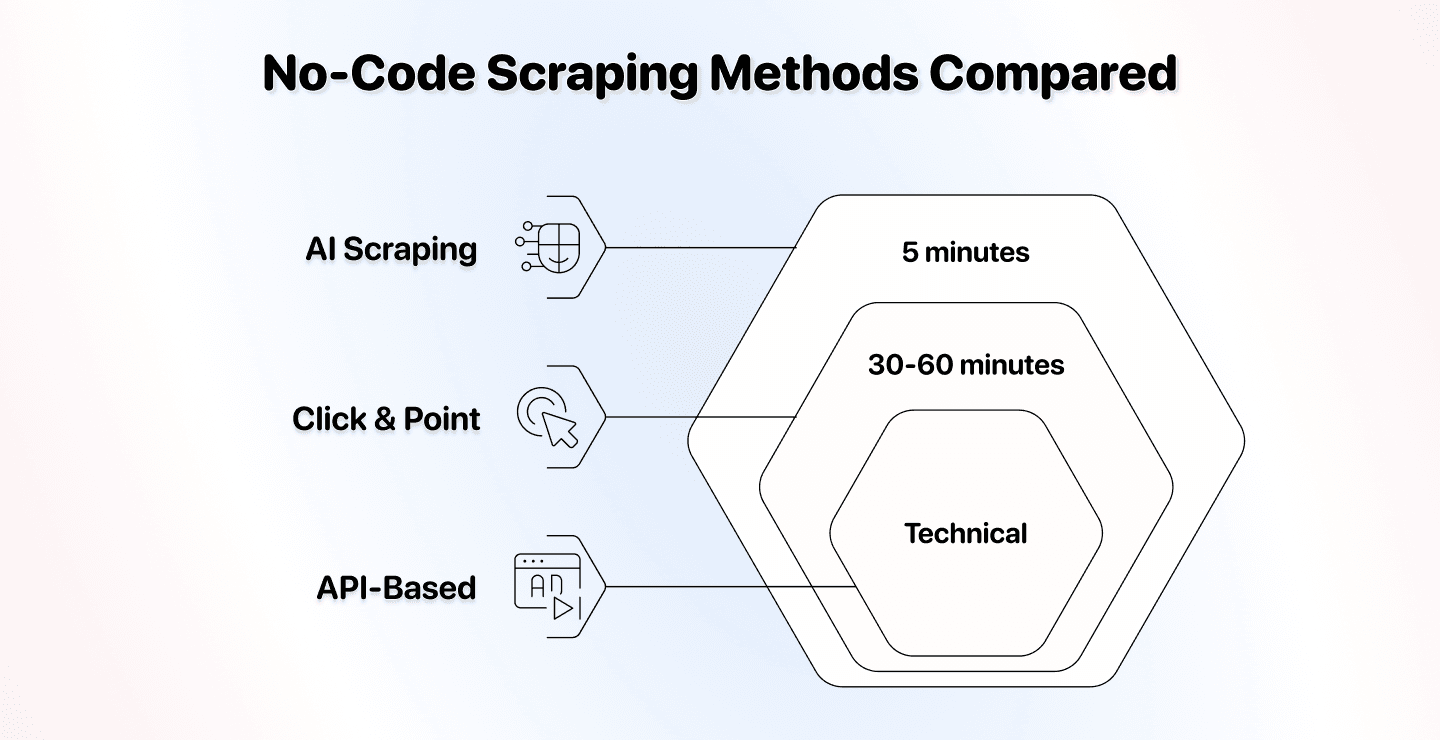

Le monde du scraping no-code propose trois méthodes bien distinctes, et choisir la mauvaise vous coûtera du temps et de l’argent.

Nous avons comparé l’AI scraping, le scraping no-code traditionnel et le scraping via API pour vous montrer les vraies différences. Pas de blabla, seulement les faits sur le temps de setup, la flexibilité, le prix et les meilleurs cas d’usage.

À la fin de ce guide, vous saurez exactement quelle méthode vous convient.

📌 Résumé pour les pressés

Cet article compare trois méthodes de scraping no-code pour vous aider à choisir la bonne selon vos besoins.

La question : Quelle méthode de scraping no-code utiliser pour vos projets ?

Ce que nous avons comparé : AI scraping, outils no-code point-and-click, et scrapers via API selon la difficulté de setup, la flexibilité, le prix, les cas d’usage et les meilleurs outils.

La réponse rapide :

- AI scraping = le plus simple pour les non-tech et s’adapte aux changements de site

- Les outils point-and-click sont idéaux si vous voulez un contrôle précis et que les sites bougent peu

- Le scraping via API est le plus économique mais nécessite des connaissances techniques

Ce que vous allez apprendre : Comment chaque méthode fonctionne, ce qui les différencie, quand utiliser chacune d’elles et quels outils donnent les meilleurs résultats.

Ce que contient cet article

- AI scraping : la méthode qui comprend le langage naturel

- Scraping no-code traditionnel : outils point-and-click

- Scraping via API : le juste milieu technique

- Notre verdict : quelle méthode choisir

AI scraping

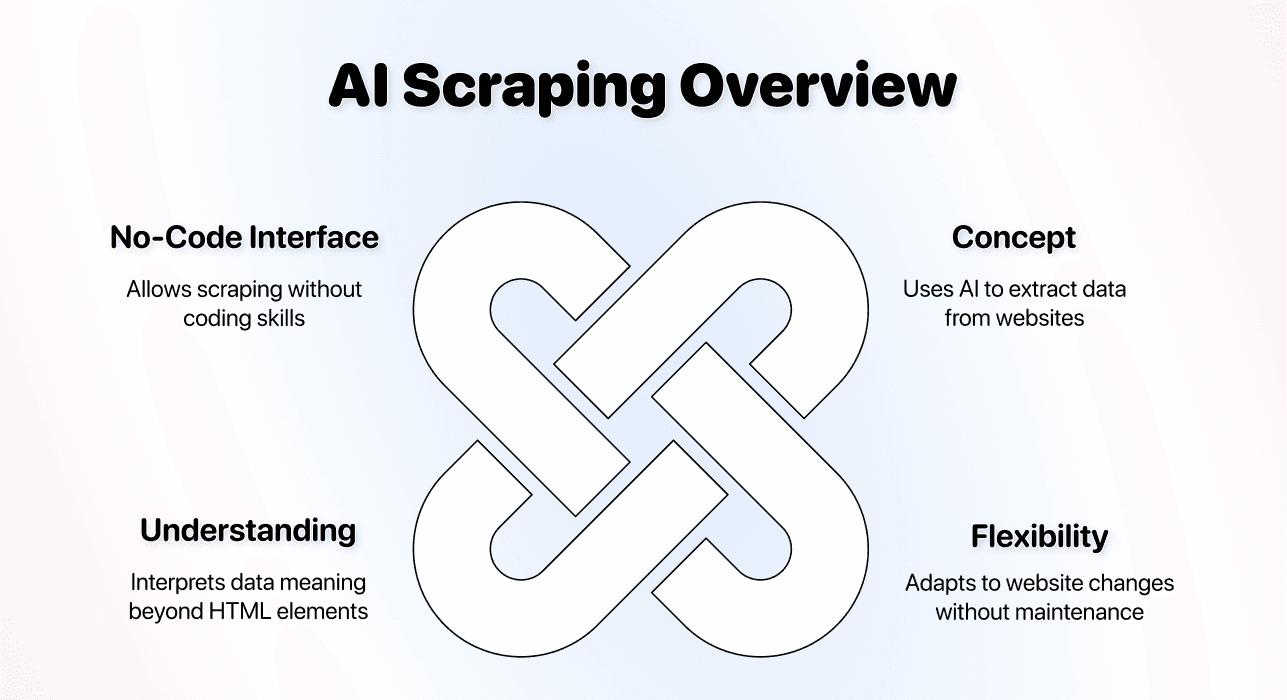

L’AI scraping représente la toute dernière forme d’extraction de données no-code. Il utilise l’intelligence artificielle pour comprendre votre intention et trouver comment récupérer les données.

Le concept

Les outils d’AI scraping s’appuient sur des grands modèles de langage et le machine learning pour extraire des données de sites web. Vous décrivez ce que vous voulez en anglais simple, et l’IA gère les aspects techniques.

On l’appelle de plusieurs façons (AI no-code scraping, AI data scraping, AI web scraping), mais l’idée est la même : utiliser des outils IA pour scraper des sites sans écrire de code ni configurer de sélecteurs techniques.

Ce qui change réellement :

↳ Les scrapers traditionnels suivent des règles rigides que vous définissez

↳↳ Les scrapers IA comprennent le contexte et s’adaptent aux changements

↳↳↳ Résultat : moins de maintenance et beaucoup plus de flexibilité

L’IA ne se limite pas à chercher des éléments HTML précis. Elle comprend que « prix du produit » signifie trouver le coût d’un article, peu importe la manière dont le site structure cette information.

Difficulté de mise en place

L’AI scraping est la méthode la plus simple à configurer parmi les trois.

Le flux type :

- Choisissez votre outil d’AI scraping

- Saisissez l’URL du site

- Décrivez les données souhaitées en langage naturel

- Lancez le scraper

Temps à prévoir : 5 minutes pour la plupart des sites[1]. Pas besoin de comprendre le HTML, les sélecteurs CSS ou l’architecture d’un site. L’IA trouve où récupérer les données à partir de votre description.

Voici une vidéo où je scrape un site e-commerce avec un agent d’AI scraping en 6,04 minutes 📺

La compétence clé : Une communication claire. Si vous savez décrire ce que vous voulez, vous pouvez configurer un scraping IA en quelques minutes.

Quelques templates d’AI scraping à découvrir

Nous créons souvent des templates de scraping pour nos utilisateurs ❤️. En voici quelques-uns :

- Comment scraper le répertoire des startups YC

- Comment scraper des biens immobiliers sur Zillow

- Comment scraper des agents immobiliers sur Zillow

- Comment scraper des propriétés sur AirBnB

- Comment scraper des entreprises sur Pages Jaunes

- Comment scraper une boutique e-commerce

- Comment scraper des case studies depuis un site

Ces templates sont aussi disponibles dans l’app Datablist et se lancent en quelques clics. Si vous voulez qu’on crée un template pour vous, contactez-nous ici 👈🏽

Flexibilité

C’est là que l’AI scraping surclasse les autres méthodes.

L’AI scraping s’adapte automatiquement quand :

↳ Les sites refondent leur mise en page

↳↳ Le contenu apparaît à des endroits inattendus

↳↳↳ Les pages utilisent des structures HTML différentes

Les scrapers no-code traditionnels (ou codés) cassent quand un site change, car ils ciblent des éléments HTML spécifiques. Les scrapers IA comprennent le sens, donc ils continuent de fonctionner même si la structure technique évolue. En clair, une fois configuré, un scraper IA reste stable.

Exemple : Vous scrapez des fiches produits sur plusieurs sites e-commerce. Chacun a une structure HTML différente. Avec l’AI scraping, vous utilisez le même prompt pour tous, et l’agent s’adapte à chaque site.

La limite : L’AI scraping fonctionne mieux pour les données publiques. Il gère mal les authentifications complexes et le contenu derrière login comparé à un scraper sur-mesure.

Prix

L’AI scraping coûte généralement plus cher par opération car il mobilise des ressources de calcul pour comprendre et traiter les pages.

Modèles de prix typiques :

- Abonnements avec crédits inclus

Facteurs de coût :

- Les sites lourds en JavaScript coûtent plus (rendu nécessaire)

- La pagination et les tâches multi-étapes augmentent le coût

- Les annuaires simples coûtent moins

Exemple concret : Scraper 1 000 fiches d’annuaire peut coûter 500 à 1 000 crédits sur la plupart des outils d’AI scraping. Le coût exact dépend de la complexité des pages et du volume de données extrait.

Est-ce que ça vaut le prix ? Pour les non-tech, oui. Vous payez pour gagner du temps, éviter la maintenance et surtout pour la tranquillité d’esprit. On pourrait l’appeler “scraping sans prise de tête”.

Cas d’usage et bonnes pratiques

L’AI scraping est idéal dans des scénarios où ses forces font la différence.

Meilleurs cas d’usage :

- Scraper plusieurs sites aux structures différentes

- Extraire des données sans compétences techniques

- Projets où la maintenance coûte cher

- Sites qui évoluent fréquemment

- Collecte de données variées nécessitant de comprendre le contexte

- Vous ne voulez pas configurer un scraper no-code traditionnel ou une API

Quand choisir l’AI scraping : Vous devez scraper les sites de concurrents pour une étude de marché, mais chacun utilise un builder et une mise en page différents. L’AI scraping gère tout ça avec le même prompt.

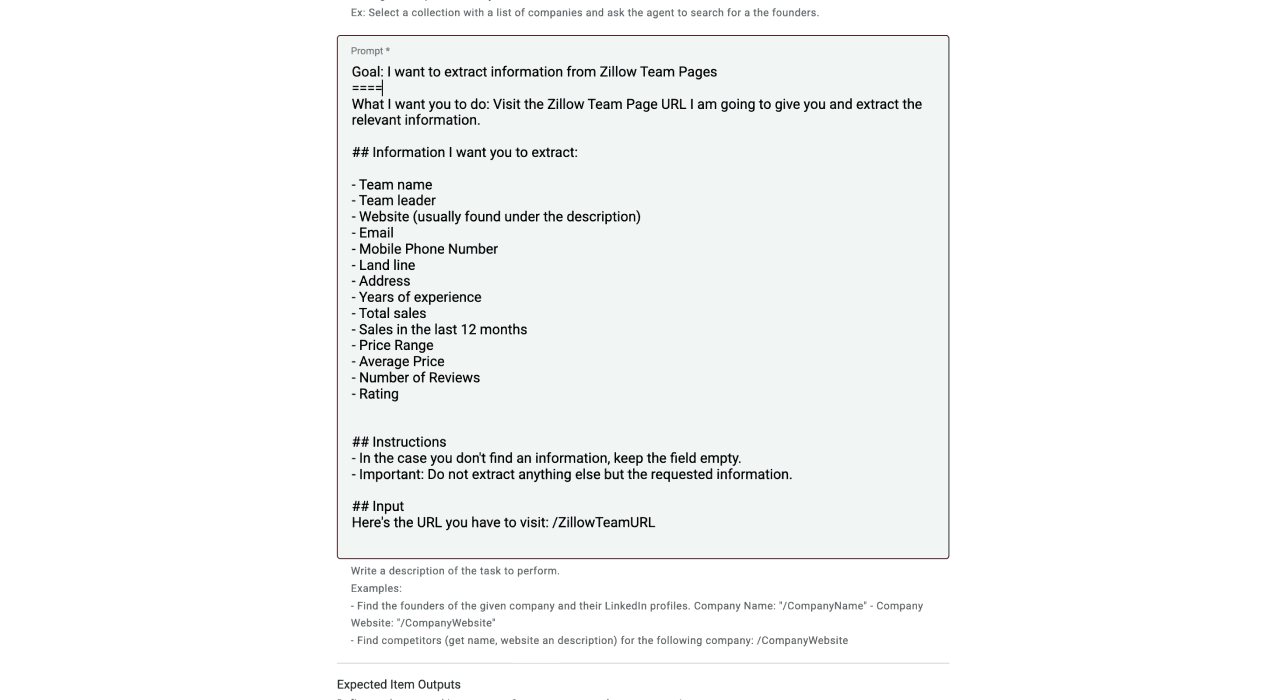

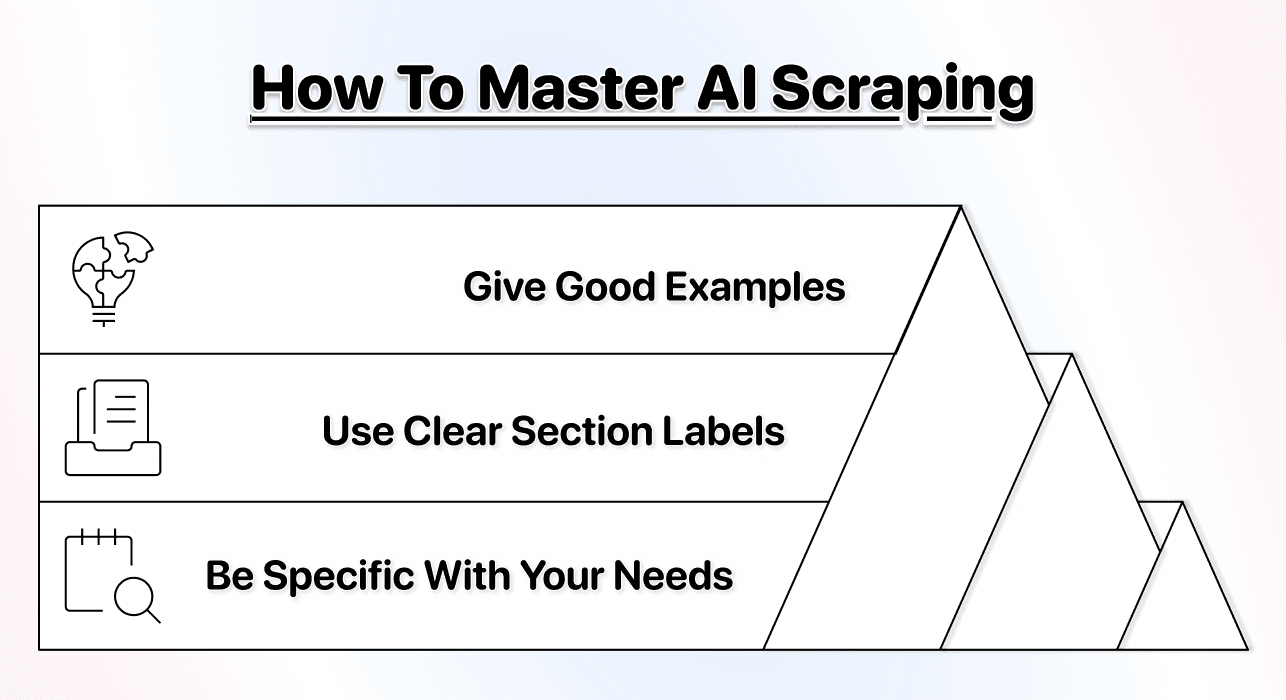

Bonnes pratiques pour l’AI scraping :

- Rédigez des prompts clairs et spécifiques sur les données voulues

- Donnez des exemples quand c’est possible pour améliorer la précision[2]

- Commencez par de petits tests avant de scaler

- Utilisez des sections et labels dans vos prompts pour de meilleurs résultats

Voici un guide utile si vous voulez approfondir comment prompt un agent IA 👈🏽

Meilleur outil à utiliser

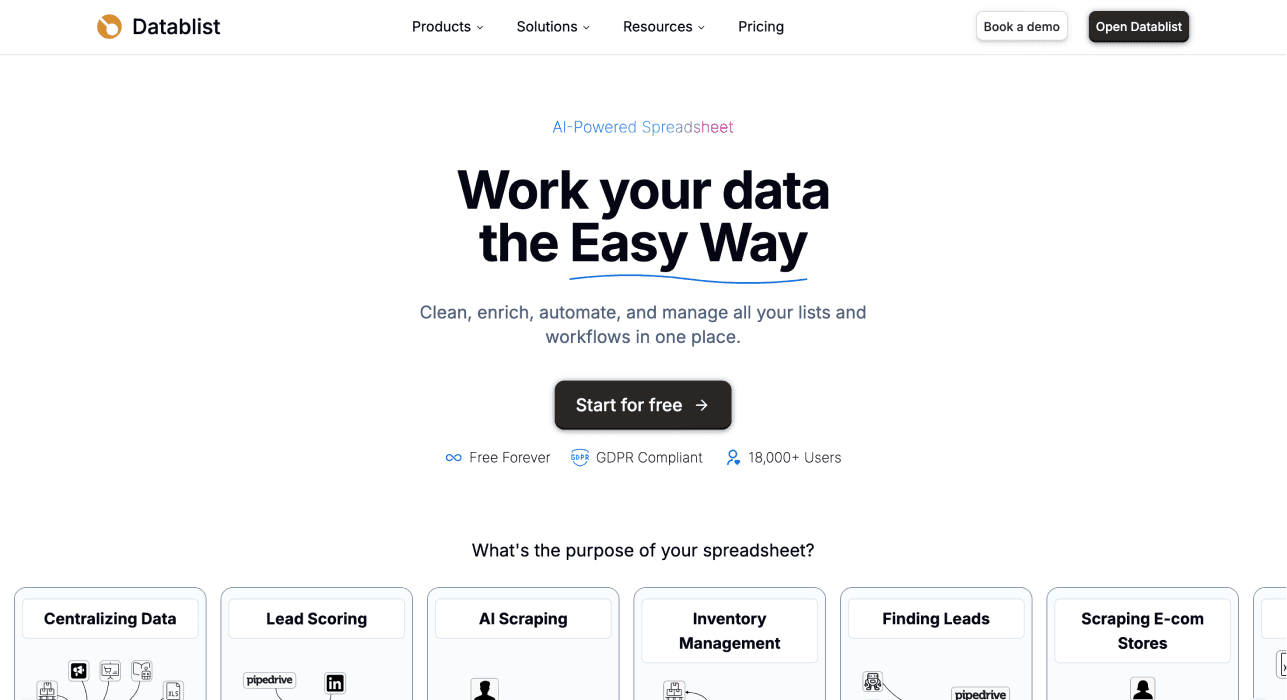

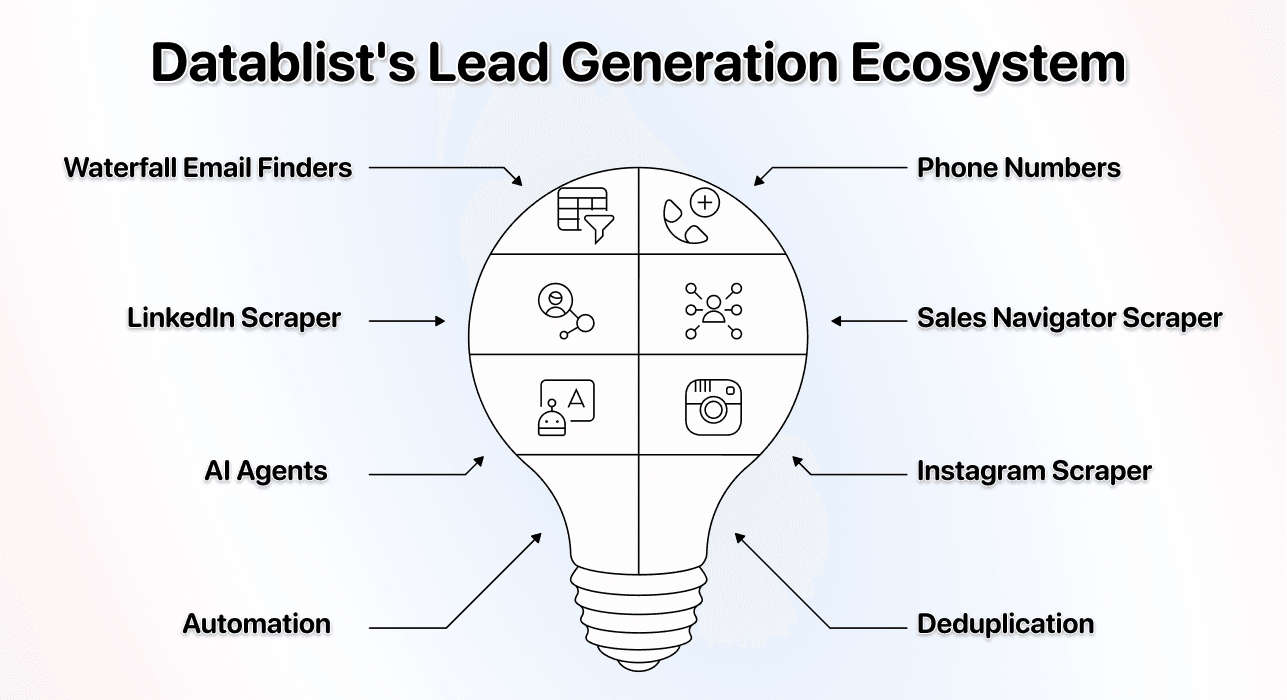

Pour l’AI scraping, Datablist s’impose comme la meilleure option pour les non-tech[3]

Pourquoi Datablist fonctionne :

- Vrai prompting en langage naturel[4] (aucune compétence technique requise)

- Plusieurs agents IA spécialisés selon les tâches de scraping[5]

- Écosystème intégré avec 60+ outils de lead generation

- Gère automatiquement le rendu JavaScript et la pagination[6]

- Tarifs accessibles dès 25 $/mois

- Intègre des capacités de bulk enrichment

Ce qui le différencie : Datablist n’est pas qu’un scraper IA. C’est une plateforme complète de lead generation qui inclut l’AI scraping ainsi que l’email finder, le sales navigator scraper et des outils de cleaning. Vous pouvez scraper une liste puis l’enrichir immédiatement avec des contacts, sans changer d’outil.

L’atout principal de Datablist : Vous obtenez l’AI scraping plus une plateforme d’automatisation complète pour soutenir l’enrichment, le lead list building ou tout autre workflow de lead generation, pour moins cher que la plupart des scrapers standalone.

📘 AI Scraping est aussi du no-code

Techniquement, l’AI scraping est une sous-catégorie du no-code scraping puisqu’il ne nécessite pas de coder. C’est la méthode no-code la plus simple, car elle demande seulement des instructions en langage naturel au lieu de comprendre la structure des sites.

Scraping no-code traditionnel (outils point-and-click)

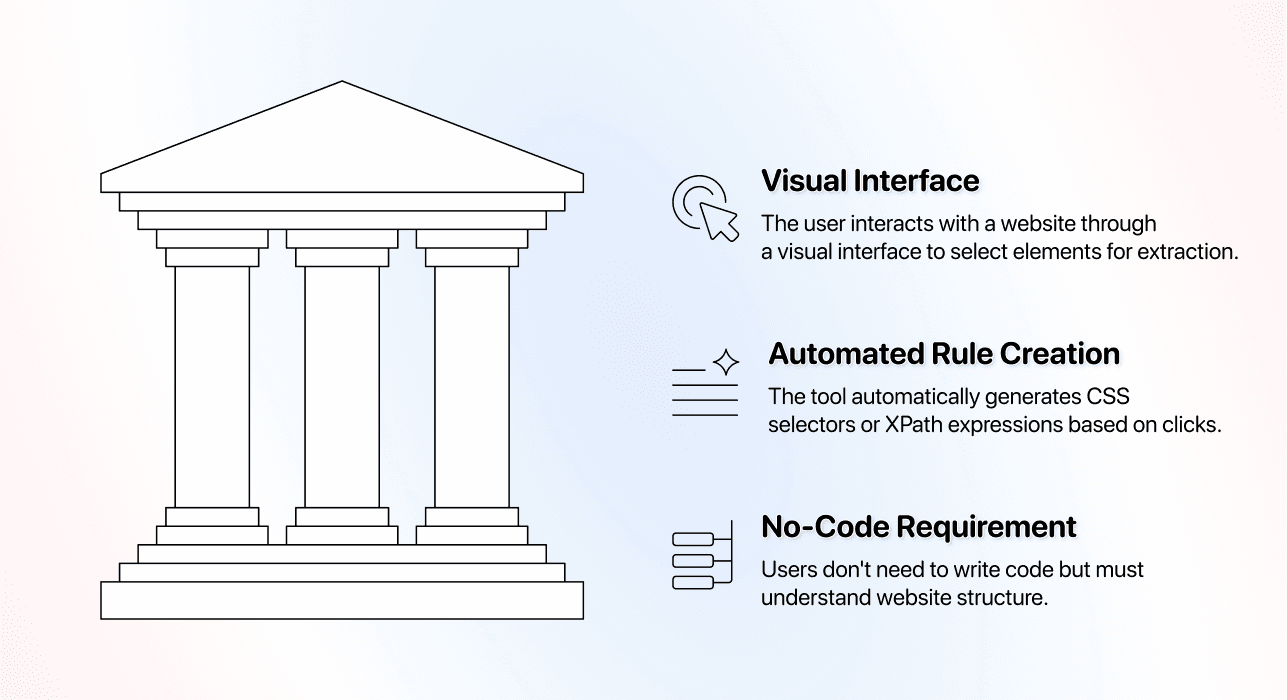

Les scrapers point-and-click sont la première génération « no-code ». Ils permettent de sélectionner visuellement des données sur une page au lieu d’écrire du code. Dans cette section, nous parlons aussi de « scraping no-code traditionnel ».

Le concept des scrapers no-code traditionnels

Le scraping no-code traditionnel utilise des interfaces visuelles où vous cliquez sur des éléments de page pour indiquer quoi extraire.

Le workflow de base : Vous ouvrez le site dans l’outil, cliquez sur le nom du produit, puis le prix, puis la description. L’outil enregistre vos clics et crée un scraper à partir de ces sélections.

Sous le capot : L’outil convertit vos clics en sélecteurs CSS ou en expressions XPath. Vous n’écrivez pas de code, mais vous créez des règles techniques rigides qui dépendent de la stabilité du HTML du site.

Pourquoi c’est « no-code » : Vous n’écrivez ni Python ni JavaScript. Mais vous devez comprendre comment un site organise l’information et parfois dépanner quand un élément est mal sélectionné.

Difficulté de mise en place

Les outils point-and-click ont une courbe d’apprentissage modérée qui surprend souvent les débutants.

Le processus de setup :

- Téléchargez et installez l’outil (beaucoup sont des apps desktop)

- Ouvrez le site cible dans l’outil

- Cliquez sur chaque donnée à extraire

- Configurez la pagination si nécessaire

- Testez pour vérifier que les bonnes données sont extraites

- Déboguez quand de mauvais éléments sont sélectionnés

- Enregistrez et lancez votre scraper

Temps à prévoir : 30 à 60 minutes pour un site de complexité moyenne.

❗️ À garder en tête

Il existe une complexité cachée avec les outils point-and-click : les éléments ne sont pas toujours bien sélectionnés. Parfois, cliquer sur un numéro de téléphone sélectionne toute la section contact, et vous ne pouvez pas corriger car la cause vient du site, pas de l’outil. Dans ce cas, vous devrez nettoyer la donnée après le scraping.

Frustrations courantes des débutants avec le no-code traditionnel :

- Cliquer un élément en sélectionne un autre

- Échanger avec le support devient une routine

- La pagination ne fonctionne pas comme prévu

- Les données sont mélangées au lieu d’être dans des champs séparés

- Les scrapers cassent après une mise à jour du site

Pour qui c’est simple : Les personnes à l’aise avec la tech et prêtes à suivre des tutoriels. Comptez quelques heures d’apprentissage avant d’être productif.

Flexibilité

Les outils point-and-click sont par nature rigides. Ils extraient exactement ce que vous avez configuré, de la manière configurée.

Quand les sites changent :

↳ Une refonte de layout casse totalement votre scraper

↳↳ De petites mises à jour CSS peuvent bloquer l’extraction

↳ ↳↳Vous devez reconstruire le scraper de zéro

La maintenance : Les sites évoluent en permanence. Les gros sites e-commerce se mettent à jour tous les trimestres. Chaque changement implique de reconfigurer votre scraper, ce qui prend autant de temps que le setup initial.

Gérer plusieurs sites : Si vous scrapez cinq sites concurrents, vous aurez cinq configurations. Chacune cassera indépendamment quand le site évolue.

L’avantage des outils point-and-click : Quand les sites ne changent quasiment jamais (bases publiques, annuaires stables), ils deviennent fiables et consistants une fois bien configurés.

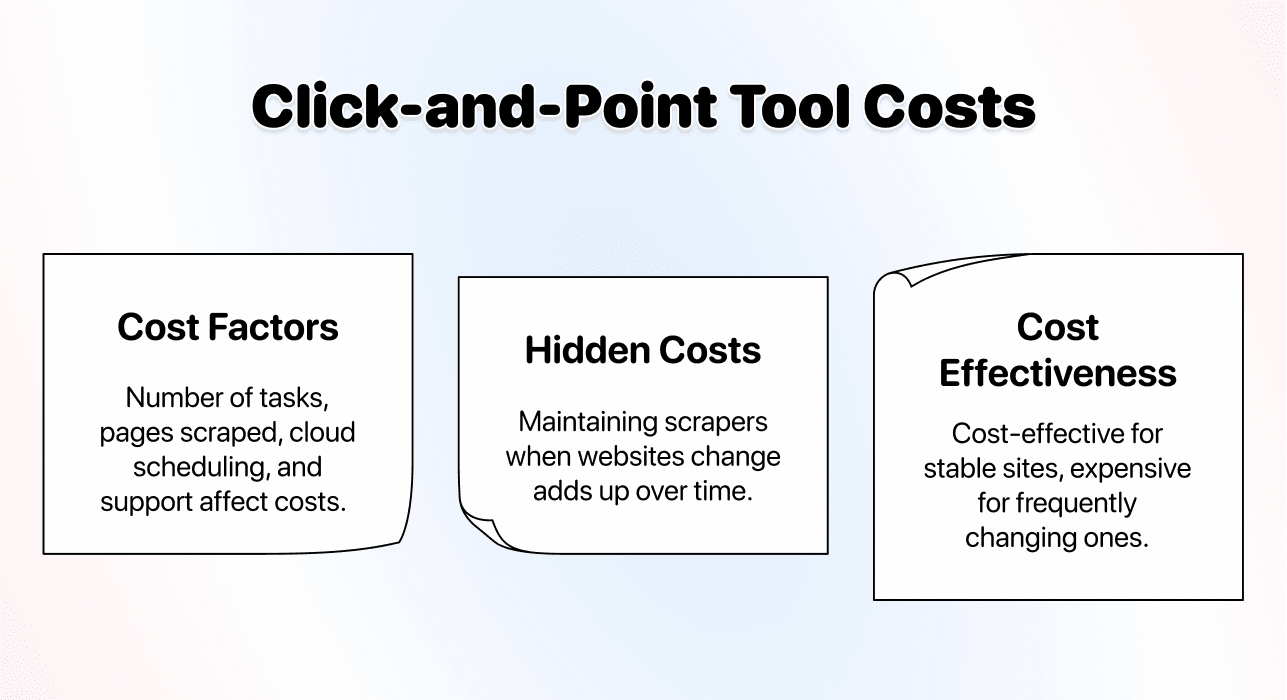

Prix

Les outils point-and-click fonctionnent généralement par abonnement à paliers.

Structures de prix courantes :

- Entrée de gamme : 50–100 $/mois

- Professionnel : 150–300 $/mois

- Entreprise : 500 $+/mois

Ce qui influence le coût :

- Le nombre de tâches de scraping que vous pouvez créer

- Le volume de pages mensuel

- L’accès au scheduling cloud

- Le support prioritaire et les fonctions avancées

Coûts cachés : Le temps passé à maintenir les scrapers quand les sites changent. Si vous passez 5 h/mois à réparer, c’est un vrai coût, même si l’abonnement semble abordable.

Rentabilité : Pour des sites qui changent rarement, les outils point-and-click sont rentables une fois en place. Pour des sites évolutifs, la maintenance les rend coûteux. Dans ce cas, pensez à un AI scraping agent

Cas d’usage et bonnes pratiques

Les outils point-and-click excellent là où leurs limites ne posent pas problème.

Meilleurs cas d’usage :

- Scraper des sites stables qui évoluent peu

- Projets où vous avez besoin d’un contrôle très précis

- Scénarios où vous scrapez le même site de façon répétée

- Workflows desktop quand le cloud n’est pas nécessaire

Quand choisir le point-and-click : Vous devez scraper une base gouvernementale qui se met à jour quotidiennement mais ne change jamais de structure. Une fois bien configuré, l’outil extraiera les nouvelles données chaque jour, à condition qu’il puisse sélectionner correctement les bons éléments.

Bonnes pratiques :

- Documentez vos configurations pour les réparer plus vite

- Mettez en place un monitoring pour détecter les pannes

- Prévoyez du temps de maintenance mensuel

- Testez à fond avant de scaler

À éviter : Si vous scrapez plusieurs sites modernes qui changent souvent (e-commerce par exemple), la maintenance devient vite ingérable. Chaque mise à jour requiert une intervention manuelle.

Meilleur outil à utiliser

Octoparse est l’outil point-and-click le plus établi du marché.

Au passage, voici un article récent où je compare les meilleurs scrapers no-code selon la facilité d’usage, les intégrations et le prix 👈🏽

Pourquoi Octoparse :

- Interface mature, développée depuis des années

- Grande bibliothèque de tutos pour les scénarios courants

- Application desktop avec des fonctions puissantes

- Bonne documentation et communauté active

Les contreparties : Octoparse demande du temps d’apprentissage. L’interface est puissante mais complexe. Les prix débutent à 83 $/mois, ce qui peut être élevé pour les indépendants et petites équipes.

Pour qui : Équipes à l’aise avec la tech, sites stables, projets récurrents où le temps de configuration est acceptable.

💡 Les scrapers traditionnels ont encore leur utilité

Les outils point-and-click ne sont pas « mauvais » ; ils ont surtout été dépassés par des méthodes plus simples comme l’AI scraping. Pour les sites anciens et figés (annuaires institutionnels), ils restent efficaces.

Scraping via API

Le scraping via API occupe un entre-deux entre le code et le no-code. Techniquement, c’est du no-code (vous n’écrivez pas la logique de scraping), mais il faut des compétences techniques pour l’utiliser.

Le concept

Les scrapers via API proposent des endpoints prêts à l’emploi pour des sites ou des cas d’usage précis.

Comment ça marche : Vous effectuez un appel API avec des paramètres (URL à scraper, données souhaitées, etc.), et le service renvoie des données structurées. La logique de scraping est déjà écrite ; vous la paramétrez via l’API.

Techniquement, c’est no-code, mais vous devez savoir faire des appels API, gérer les tokens d’authentification, parser des réponses JSON, et intégrer les résultats dans votre workflow. Cela demande des notions de programmation ou l’aise avec des outils comme Postman.

Approches API courantes :

- APIs spécifiques à un site (ex. LinkedIn scraper APIs)

- APIs génériques qui fonctionnent sur n’importe quelle URL

- APIs basées sur des templates préconfigurés pour les sites populaires

Confusion de vocabulaire : Certains parlent de « no-code » car vous n’écrivez pas la logique de scraping. D’autres disent « low-code » car il faut des compétences techniques. La réalité est entre les deux.

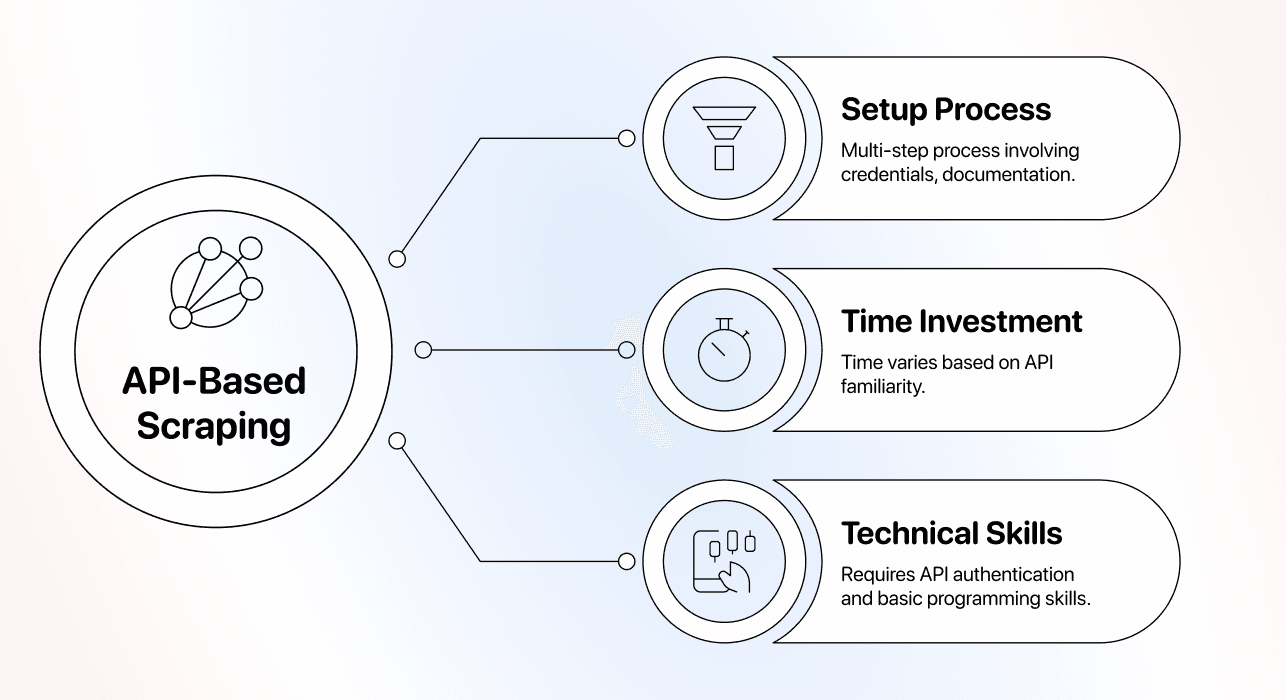

Difficulté de mise en place

Le scraping via API exige des compétences qui le placent au-delà du « vrai no-code ».

Le processus de setup :

- Inscrivez-vous et récupérez des identifiants API

- Lisez la doc pour comprendre les paramètres

- Testez des appels avec Postman ou curl

- Gérez l’authentification et le rate limiting

- Parsez la réponse JSON ou XML

- Intégrez le résultat dans votre app ou workflow

- Implémentez la gestion d’erreurs

Temps à prévoir : 1–2 h si vous êtes à l’aise avec les APIs, bien plus sinon.

Compétences requises :

- Compréhension des REST APIs et requêtes HTTP

- Manipulation de structures JSON

- Gestion des tokens et headers d’authentification

- Programmation basique pour intégrer les résultats

Flexibilité

Les scrapers via API offrent une flexibilité modérée, totalement dépendante du provider.

Ce que vous contrôlez : La plupart permettent de définir les points de données, les limites de débit, le format de sortie, et quelques comportements via paramètres.

Ce que vous ne contrôlez pas : La logique de scraping est une boîte noire. Si l’API ne supporte pas un site ou un type de donnée, vous êtes bloqué.

Quand les sites changent : Les bons providers maintiennent et adaptent leurs scrapers automatiquement. Les mauvais peuvent mettre des semaines à réagir.

Le risque de dépendance : Vous dépendez entièrement du provider. S’il ferme, change ses prix, ou cesse de maintenir certains scrapers, votre workflow casse sans plan B.

Quand la flexibilité est clé : Si vous devez scraper des sites non pris en charge ou extraire des données non supportées, vous serez limité. Dans ce cas, un scraper custom ou l’AI scraping est préférable.

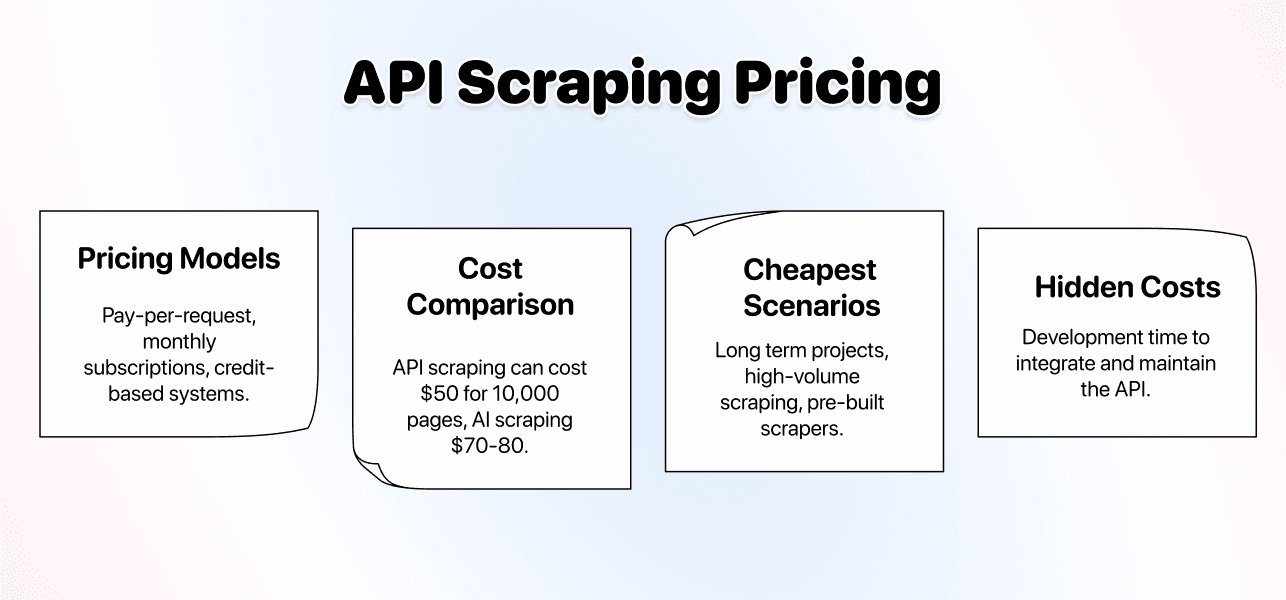

Prix

Le scraping via API est souvent le plus rentable pour du volume élevé sur des pages simples.

Modèles de prix typiques :

- Paiement à la requête (quelques centimes par scrape réussi)

- Abonnements mensuels avec requêtes incluses

- Systèmes de crédits avec remises volume

Comparaison de coûts : Pour 10 000 pages simples/mois, une API coûte ~50 $. Le même volume en AI scraping peut coûter 70–80 $, mais le setup est bien plus rapide.

Quand l’API est la moins chère :

- Projets long terme où le temps de dev importe peu

- Scraping à fort volume de sites simples et stables

- Scrapers préconstruits pour des plateformes populaires

Quand ça devient coûteux : Si vous avez besoin d’une extraction sur-mesure non supportée, vous perdrez temps et budget à contourner les limites. La solution « pas chère » devient inutile si elle ne correspond pas à vos besoins.

Coûts cachés : Temps de dev pour intégrer et maintenir l’API. Si vous n’êtes pas technique, il faudra externaliser, ce qui change totalement l’équation.

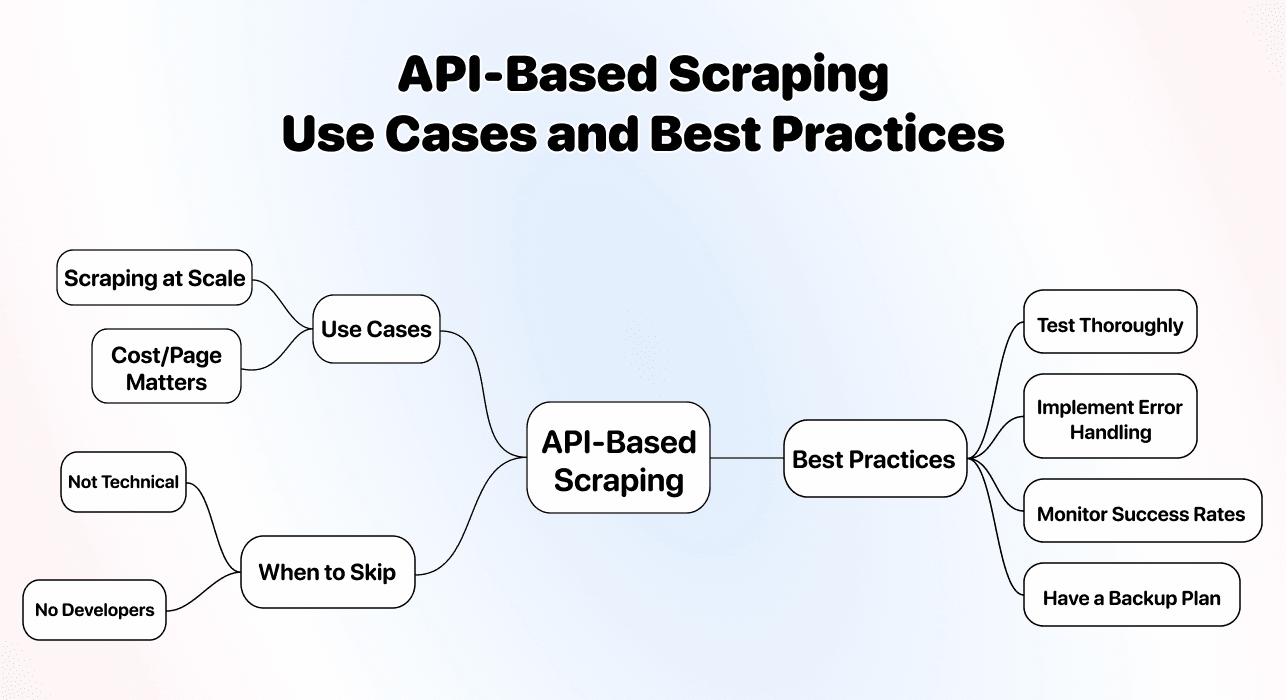

Cas d’usage et bonnes pratiques

Le scraping via API convient aux équipes techniques qui font du scraping répétitif à grande échelle.

Meilleurs cas d’usage :

- Scraper à grande échelle (milliers ou millions de pages)

- Intégrer le scraping dans des applications

- Projets où le coût par page prime sur la facilité d’usage

Bonnes pratiques :

- Testez à fond avant de vous engager sur un provider

- Implémentez une gestion robuste des erreurs

- Surveillez les taux de succès pour détecter les pannes

- Prévoyez un plan B si le provider ferme ou change ses conditions

À éviter : Si vous n’êtes pas technique et n’avez pas de devs, les APIs vous frustreront. Les économies ne comptent pas si vous ne pouvez pas les exploiter.

Meilleur outil à utiliser

Le « meilleur » scraper via API dépend de votre cible, mais voici de bonnes options :

-

Pour le web en général : ScrapingBee et Bright Data fournissent des APIs fiables pour la plupart des sites. Elles gèrent proxies, rendu navigateur et anti-bot automatiquement.

-

Pour des plateformes spécifiques : Cherchez des APIs spécialisées (LinkedIn, Amazon, etc.). Elles sont optimisées pour ces sites et leurs contraintes.

Ce qu’il faut regarder :

- Documentation claire et exemples

- Disponibilité et support fiables

- Tarification transparente sans frais cachés

- Bon taux de réussite sur vos sites cibles

La réalité : Même les meilleures APIs exigent des compétences techniques. Si « faire des appels API » vous semble complexe, choisissez l’AI scraping ; vous aurez plus de contrôle et de sérénité.

💡 API scraping : économique mais technique

Le scraping via API offre le meilleur coût par page pour les projets volumineux, mais il faut des compétences pour l’exploiter. Ne choisissez pas cette voie uniquement pour le prix si vous ne pouvez pas l’implémenter ; souvenez-vous : « pas cher, deux fois payé ».

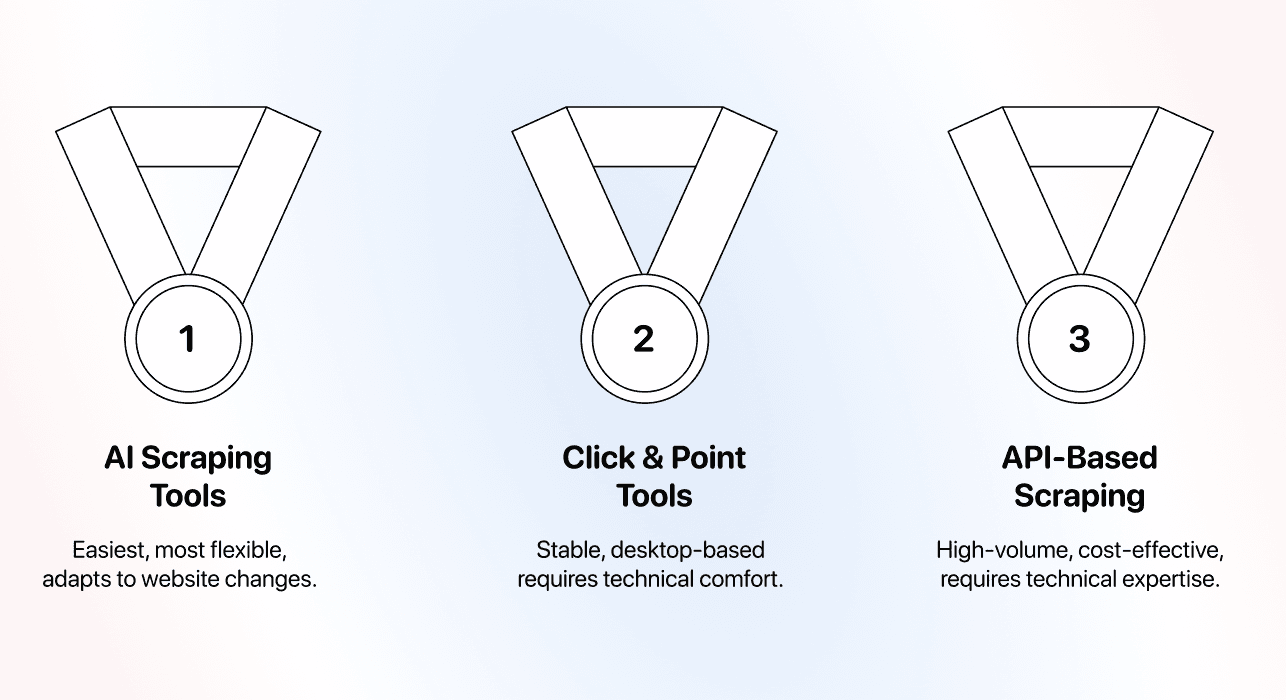

En résumé : quelle méthode choisir ?

Après avoir comparé les trois méthodes, voici comment sélectionner celle qui vous convient.

Choisissez l’AI scraping si :

- Vous n’êtes pas technique et cherchez la simplicité

- Le temps de maintenance vous coûte cher

- Les sites ciblés évoluent fréquemment

- Vous voulez ajuster facilement les données à extraire

Idéal pour : Utilisateurs non-tech, petites équipes, lead list building, études de marché, veille concurrentielle, et projets où le temps et la simplicité priment sur quelques centimes par page.

Meilleur outil : Datablist pour une vraie expérience no-code avec instructions en langage naturel.

Choisissez les outils point-and-click si :

- Vous scrapez des sites stables qui changent peu

- Vous êtes à l’aise avec des notions techniques

- Vous acceptez la maintenance lors des mises à jour

- Vous préférez les applications desktop aux outils web

Idéal pour : Équipes techniques, sites institutionnels stables, projets où le temps de configuration n’est pas le sujet principal.

Meilleur outil : Octoparse pour ses fonctions matures et sa documentation.

Choisissez le scraping via API si :

- Vous êtes technique ou avez des développeurs

- Vous scrapez à grand volume (milliers de pages/jour)

- Le coût par page est votre priorité

- Vous intégrez le scraping dans des applications

Idéal pour : Équipes techniques, projets à fort volume, intégrations applicatives, contextes où le temps de dev est disponible et le coût par page prioritaire.

Meilleurs outils : ScrapingBee ou Bright Data pour le général, APIs spécialisées pour des plateformes ciblées.

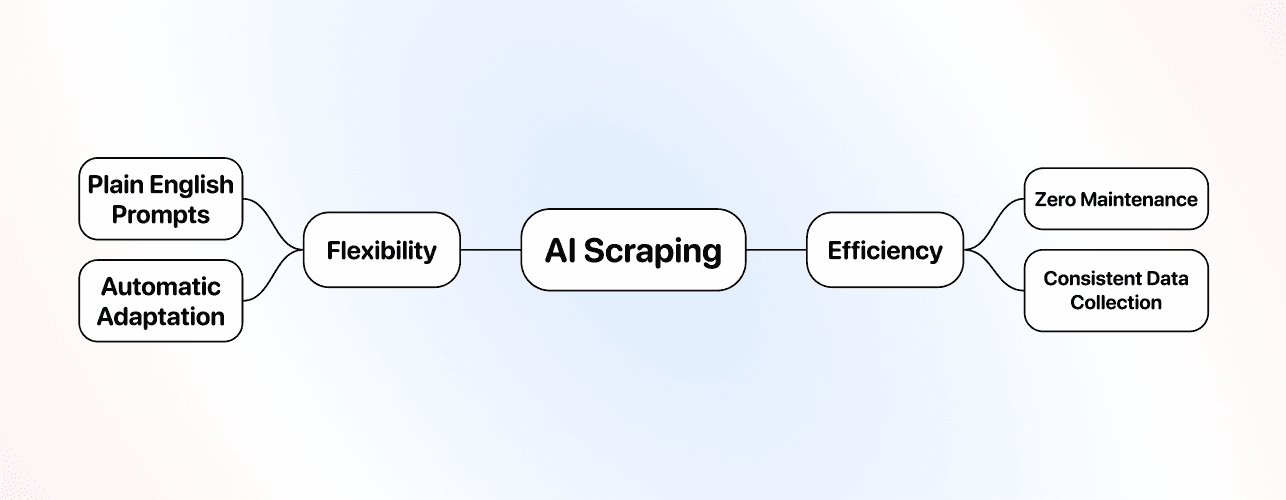

Notre recommandation pour la majorité

Pour 80 % des utilisateurs, l’AI scraping est le bon choix. Sa simplicité, sa flexibilité et l’absence de maintenance justifient largement un coût par page légèrement supérieur.

Le paysage du scraping no-code a évolué. Ce qui nécessitait des compétences techniques ou des heures de configuration se fait désormais en quelques minutes avec des instructions claires.

Voici 3 raisons simples de commencer par l’AI scraping :

- C’est la méthode la plus simple

- C’est la méthode la plus flexible

- Elle ne demande aucune maintenance

Et si vous devez dépasser 10 000 pages/jour, vous pourrez basculer sur des scrapers via API.

FAQ

Quelle est la méthode de scraping no-code la plus efficace ?

Tout dépend de votre métrique. Le scraping via API est le plus rentable à très gros volume si vous êtes technique. L’AI scraping est le plus rapide en setup et maintenance si vous n’êtes pas technique. Pour la plupart des utilisateurs, l’AI scraping offre la meilleure efficacité globale en supprimant les barrières techniques et la maintenance.

L’AI scraping est-il meilleur que le no-code scraping ?

L’AI scraping est un type de no-code scraping, simplement la version la plus avancée. Derrière cette question, on compare souvent l’AI scraping aux outils point-and-click. La réponse est oui dans la majorité des cas : l’AI s’adapte automatiquement aux changements de site, demande moins de notions techniques et de maintenance, et coûte moins cher au global que les outils point-and-click.

L’AI scraping est-il cher ?

L’AI scraping coûte plus par page que les méthodes via API, mais moins que le coût total des outils point-and-click. Pour 1 000 fiches d’annuaire, prévoyez 800–1 200 crédits (coût exact selon l’outil et la complexité des pages). La valeur vient de l’absence de maintenance et de compétences techniques, ce qui fait gagner du temps et de l’argent aux non-tech.

Qu’est-ce que le AI no-code scraping ?

Le AI no-code scraping (AI scraping) consiste à utiliser l’IA pour extraire des données de sites sans écrire de code ni configurer de sélecteurs techniques. Vous décrivez les données voulues en anglais simple ; l’IA comprend votre intention et gère les détails techniques. Il combine l’accessibilité du no-code avec l’intelligence nécessaire pour s’adapter automatiquement à des structures de sites différentes.

Puis-je combiner plusieurs méthodes de scraping ?

Oui, et beaucoup d’équipes le font. Utilisez l’AI scraping pour l’exploration, les nouveaux sites et les situations où la flexibilité compte. Une fois des tâches répétitives et volumineuses identifiées, migrez ces tâches spécifiques vers des APIs pour optimiser les coûts — en gardant à l’esprit que cela demande des notions techniques et du temps.